Introduction

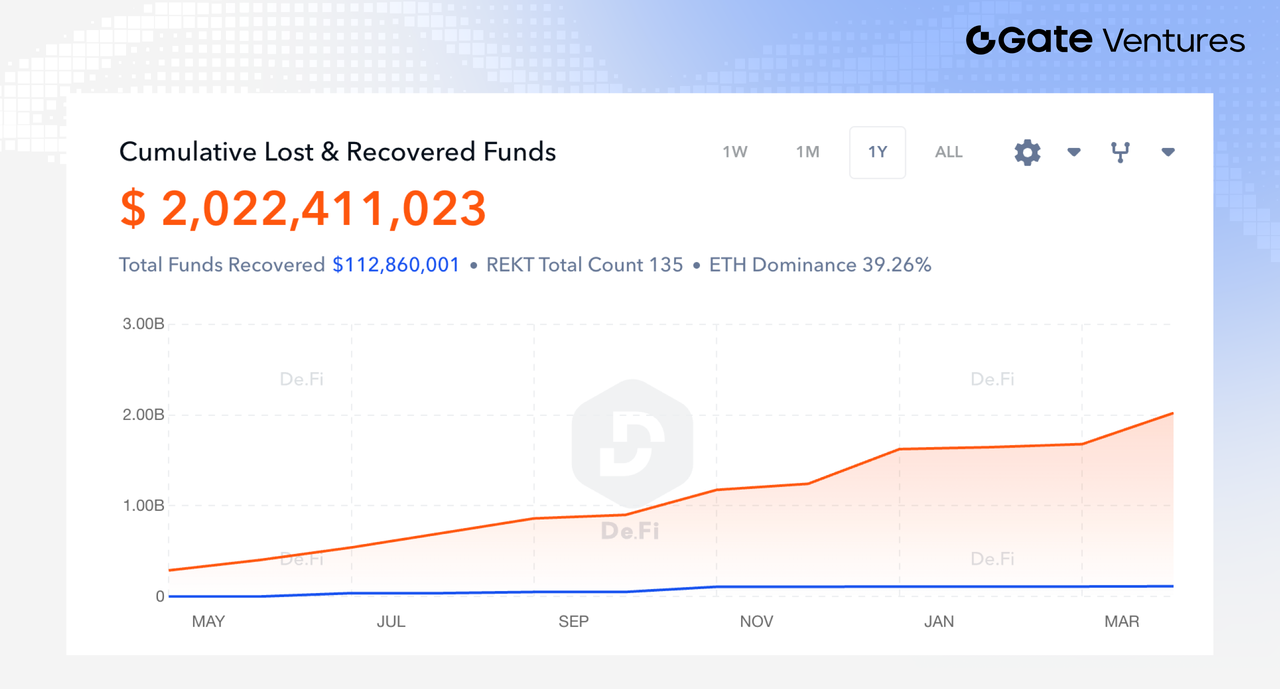

Source : de.fi

Au cours de l’année écoulée, le secteur DeFi a enregistré des pertes cumulées de 2,02 milliards de dollars, avec seulement environ 5 % des fonds dérobés finalement récupérés. Ce chiffre représente environ 1,1 fois la valeur totale verrouillée (TVL) de Curve Finance, soulignant à quel point les incidents de sécurité continuent d’éroder la base de capital de l’industrie.

Depuis mars de cette année, la DeFi a connu une série de failles de sécurité notables :

Solv Protocol a perdu 2,73 millions de dollars en raison d’une vulnérabilité de double émission dans sa fonction mint(). Venus Protocol a subi 2,18 millions de dollars de créances douteuses sur BSC après le contournement d’un contrôle du plafond d’approvisionnement. Resolv Labs a essuyé une perte de 25 millions de dollars à la suite de la fuite d’une clé privée, permettant l’émission non autorisée de 80 millions de dollars de USR non garantis. Drift Protocol a connu la plus grande attaque de 2026 à ce jour, avec plus de 280 millions de dollars dérobés. Les attaquants ont passé plusieurs semaines à préparer leur exploitation, utilisant l’ingénierie sociale pour obtenir 2 signatures sur 5 du multisig, puis ont pris le contrôle des permissions de gestion, transférant en peu de temps plus de la moitié des fonds du protocole. Par ailleurs, KelpDAO a été confronté à un incident de sécurité sur ses actifs sous-jacents, déclenchant un risque de contagion sur rsETH et une crise de liquidité, accentuant la pression sur les actifs liés aux LRT.

Ces événements révèlent une réalité difficile : quelle que soit l’avancée technologique sous-jacente, les fonds des utilisateurs restent exposés à des risques extrêmes impossibles à éliminer totalement.

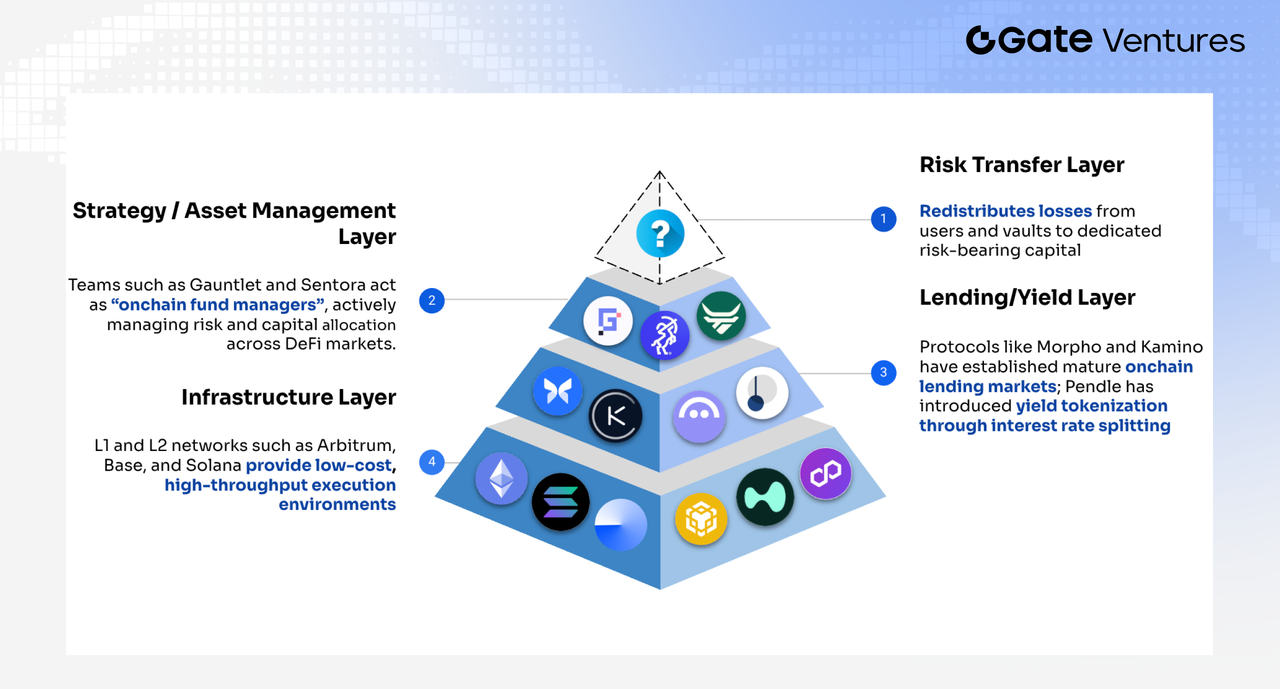

En réalité, la DeFi a néanmoins posé des bases solides dans plusieurs autres domaines au cours des dernières années :

Couche d’infrastructure : Ethereum a finalisé The Merge, tandis que Base, Solana et d’autres L1/L2 continuent d’offrir des environnements d’exécution à faible coût et à haut débit. Le règlement on-chain tend vers la stabilité et la fiabilité des infrastructures financières traditionnelles.

Couche de prêt/rendement : Des protocoles comme Aave, Morpho et Kamino ont établi des marchés de prêts on-chain matures. Pendle a permis la dissociation des taux d’intérêt, enrichissant la gamme des produits de rendement.

Couche stratégie/gestion d’actifs : Des équipes professionnelles de gestion des risques telles que Gauntlet, Steakhouse Financial et MEV Capital interviennent désormais en tant que « gérants de fonds on-chain », pilotant activement la gestion du risque et du rendement.

Pourtant, malgré ces avancées, la pile DeFi présente encore une lacune majeure dans un domaine crucial : le transfert du risque.

Benchmarking TradFi : la couche d’assurance manquante

Les systèmes financiers traditionnels peuvent soutenir des centaines de milliers de milliards de dollars d’actifs, non seulement grâce à la régulation mais aussi à un mécanisme complet de transfert du risque : les dépôts bancaires sont protégés par la FDIC, les comptes titres par la SIPC, et les opérations institutionnelles sont couvertes par des produits dérivés de crédit.

Le secteur de l’assurance joue le rôle « d’amortisseur » du système financier. Les primes d’assurance mondiales représentent environ 6 à 7 % du PIB mondial, et en incluant les actifs gérés par les compagnies d’assurance, leur influence sur les marchés de capitaux dépasse largement ce pourcentage. (1)

À l’inverse, les primes d’assurance on-chain représentent moins de 1 % de la TVL de la DeFi — un écart qui révèle un potentiel de marché considérable.

Pourquoi l’assurance DeFi est-elle si complexe ?

Des risques difficiles à quantifier — Les modèles traditionnels de tarification ne sont pas transposables

La DeFi est confrontée à des risques complexes et hétérogènes : vulnérabilités de smart contracts, dépegging de stablecoins, défaillances d’oracle, souvent simultanés et se renforçant mutuellement. Contrairement à l’assurance traditionnelle, la DeFi manque de données historiques de sinistres, vérifiables et sur le long terme, rendant inopérants les modèles actuariels classiques basés sur la distribution des pertes et la fréquence des incidents.

De plus, les risques en DeFi sont bien moins délimités qu’en assurance traditionnelle. Dans les systèmes classiques, les objets assurables (biens immobiliers, véhicules, personnes) présentent des frontières de risque claires et indépendantes. En DeFi, la composabilité des protocoles fait qu’une défaillance peut se propager via la liquidité, les garanties, les stratégies de rendement et les mécanismes de liquidation, entraînant des pertes croisées entre protocoles. Cela brouille les lignes en matière de couverture, de responsabilité et de détermination des pertes.

Faible efficacité du capital — Difficile de rivaliser avec les rendements natifs de la DeFi

L’assurance nécessite par essence de mobiliser d’importantes réserves pour couvrir d’éventuels sinistres. Mais en DeFi, les utilisateurs et fournisseurs de liquidité préfèrent allouer leur capital à des stratégies générant des rendements continus plus élevés — tels que le prêt, le market making, l’arbitrage ou l’agrégation de rendement.

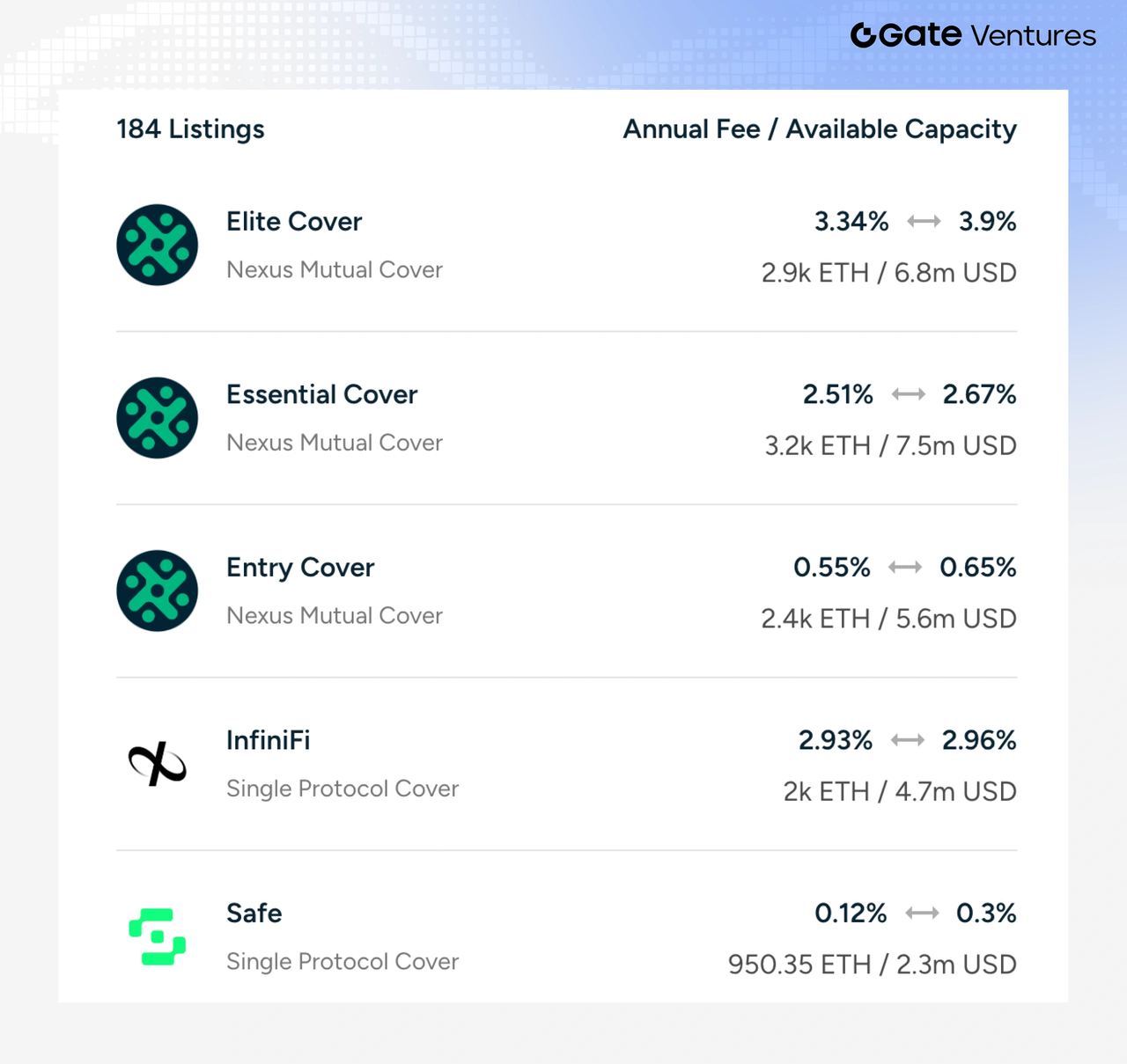

Source : Nexus Mutual

Actuellement, la plupart des pools d’assurance on-chain offrent des rendements inférieurs à ceux des produits DeFi classiques, les rendant moins attractifs face à d’autres opportunités. Ce coût d’opportunité limite la capacité des pools d’assurance à attirer suffisamment de capital de souscription, restreignant ainsi la profondeur et l’évolutivité des produits d’assurance.

Analyse sectorielle

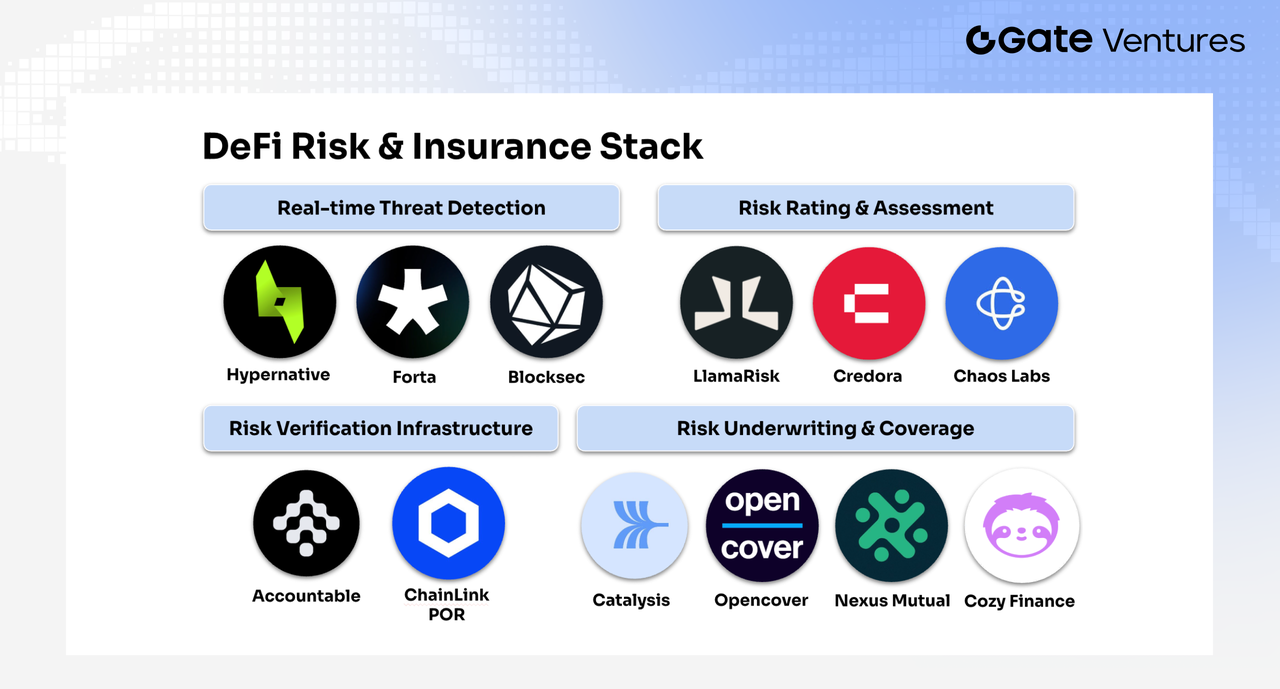

Malgré ces lacunes, on observe déjà les prémices d’un écosystème d’assurance et de gestion du risque on-chain :

À une extrémité, on trouve de véritables pools de transfert de risque comme Nexus Mutual. À l’autre, des plateformes comme Catalysis et OpenCover intègrent des mécanismes de protection directement dans les flux de dépôts et de produits, soutenues par des notations de risque fournies par Credora et LlamaRisk, des vérifications par Accountable, et une détection en temps réel par Hypernative et Blocksec.

Définissons quatre couches fonctionnelles :

Couverture/souscription : La couche qui absorbe en dernier ressort les pertes, collecte les primes et gère les sinistres. Elle intègre la protection nativement dans les coffres ou les flux de produits, faisant de la couverture une fonctionnalité intrinsèque plutôt qu’un ajout.

Notation de risque : Convertit les risques en scores comparables, recommandations de capital et paramètres.

Vérification : Confirme l’existence effective des actifs, passifs et réserves, vérifiables on-chain.

Détection : Fournit des alertes, un filtrage des transactions, des simulations ou des blocages automatisés avant la survenue de pertes.

Ces quatre couches constituent le cadre d’analyse de cet article.

Couche de souscription

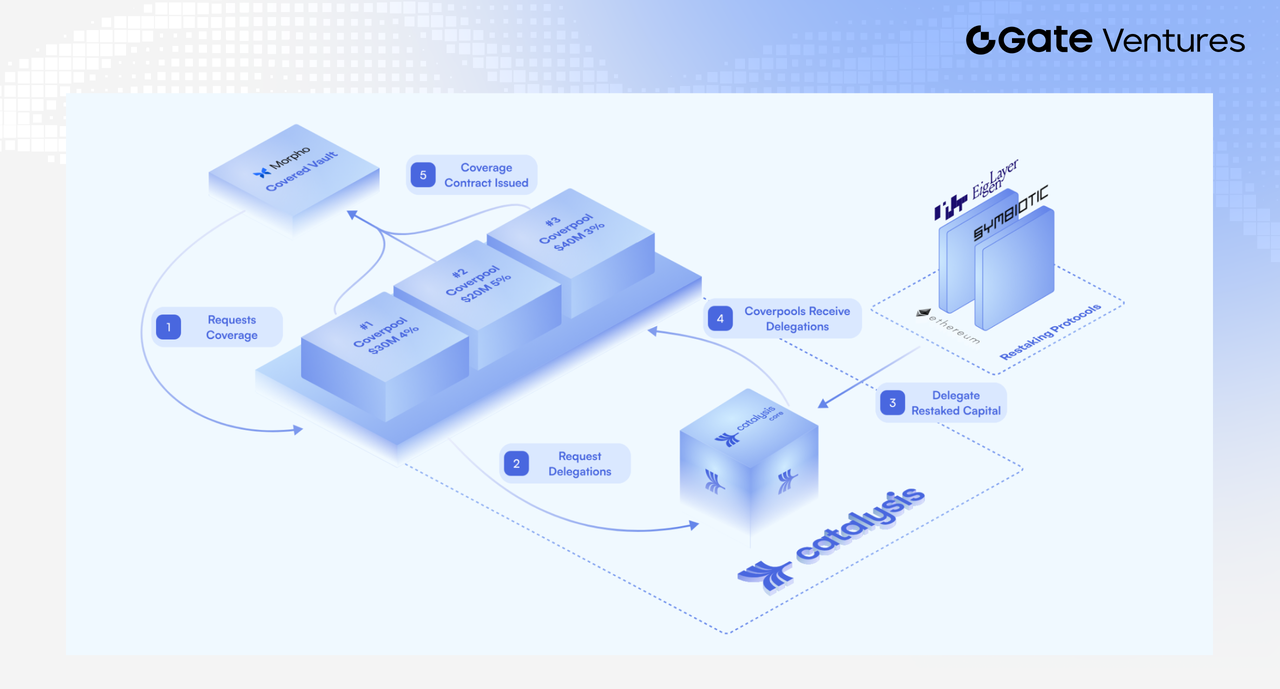

L’innovation principale de Catalysis consiste à intégrer la protection contre le risque directement dans les coffres DeFi, faisant de la couverture une composante du processus d’allocation d’actifs, et non un achat d’assurance séparé. Autrement dit, lorsqu’un utilisateur dépose des fonds dans un coffre, il bénéficie automatiquement d’une protection contre le risque correspondante — sans avoir à rechercher un protocole d’assurance distinct.

Concrètement, Catalysis relie trois types de participants dans un processus de souscription on-chain complet :

Source : Catalysis

Premièrement, les restakers déposent des actifs tels que ETH, BTC ou stablecoins dans des protocoles de restaking comme EigenLayer et Symbiotic, constituant un pool économique de sécurité activable via slashing — le capital de souscription initial du système. Ensuite, ce capital est alloué à différents CoverPools, chacun couvrant une catégorie de risque spécifique (par exemple, un coffre de prêt ou une stratégie de rendement donnée). Enfin, les utilisateurs des coffres paient des frais de couverture pour la protection, et ces frais sont redistribués aux restakers qui fournissent le capital de souscription. (2)

Comment le risque est-il tarifé ?

Chez Catalysis, la tarification du risque n’est pas décidée au cas par cas par un comité d’assurance, mais exécutée automatiquement selon un modèle de paramètres défini par le protocole. La logique est simple : plus le risque est élevé, plus il faut de capital de souscription activable via slashing, ce qui entraîne des frais de protection plus élevés.

Concrètement, chaque CoverPool définit des paramètres de capacité de souscription, de ratios de slashing et de taux de frais selon les types de risque des coffres. Ces paramètres déterminent la quantité de capital restaké à immobiliser en garantie et le montant des frais de couverture — autrement dit, le « coût de location du capital de souscription ».

Comme le capital de souscription provient des restakers, les taux sont aussi influencés par l’offre de capital : lorsque l’offre est abondante, les frais de protection baissent ; en cas de rareté, ils augmentent. La tarification du risque résulte donc à la fois des paramètres du protocole et de la dynamique offre-demande du marché.

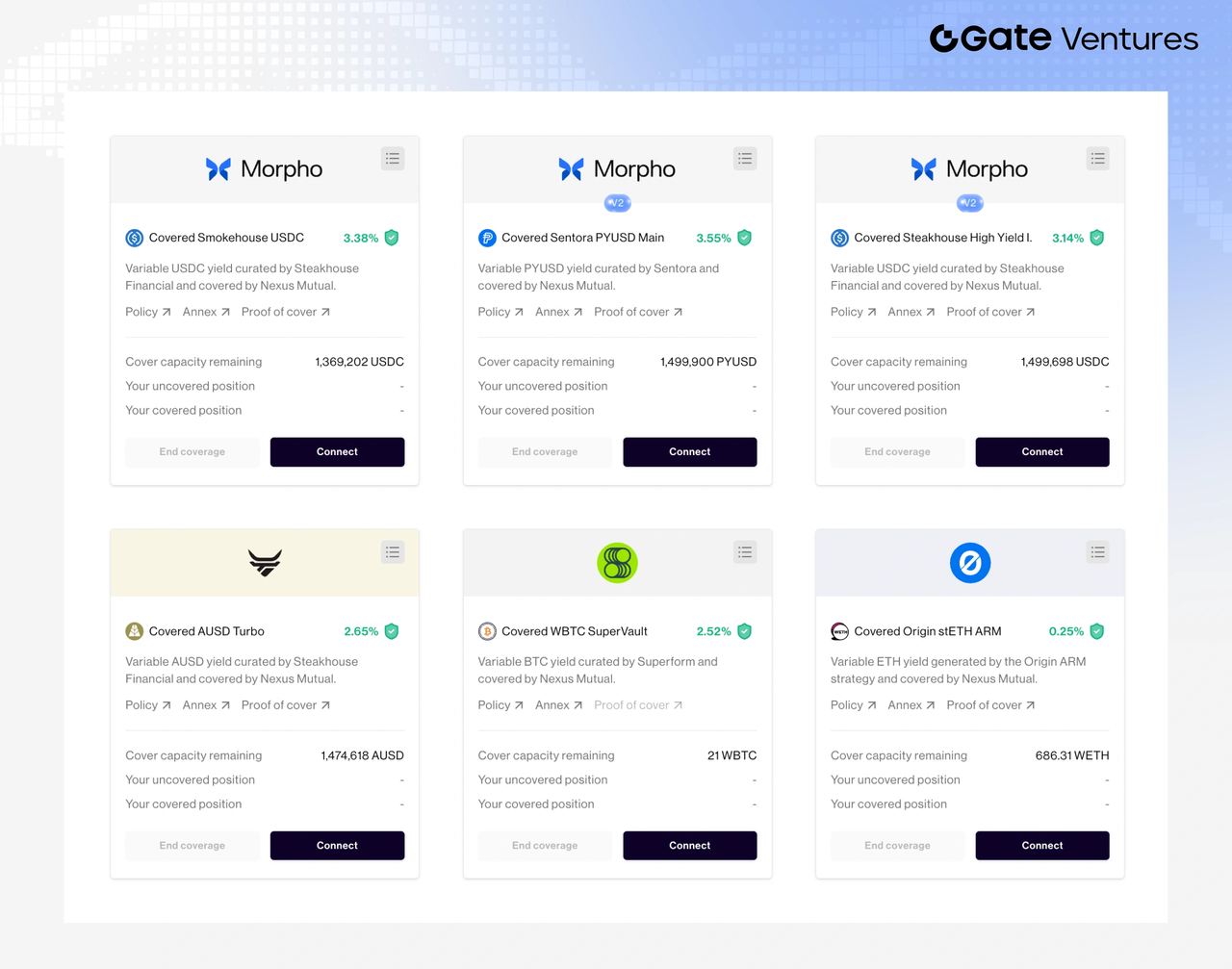

OpenCover constitue une autre « infrastructure de protection intégrée », mais n’assume pas le rôle de souscripteur final. Elle agit comme une plateforme de distribution et de structuration, conditionnant la couverture sous-jacente en modules intégrables directement dans les flux produits DeFi. (3)

Source : Opencover

OpenCover ne fournit pas elle-même de capital de souscription.

La couverture effective des Covered Vaults est assurée par Nexus Mutual : lors du dépôt de parts de coffre, le pool de staking de Nexus Mutual immobilise en temps réel une quantité correspondante de NXM, servant de capital de souscription on-chain vérifiable. Cela permet d’ajuster la capacité de couverture à l’exposition au risque du coffre.

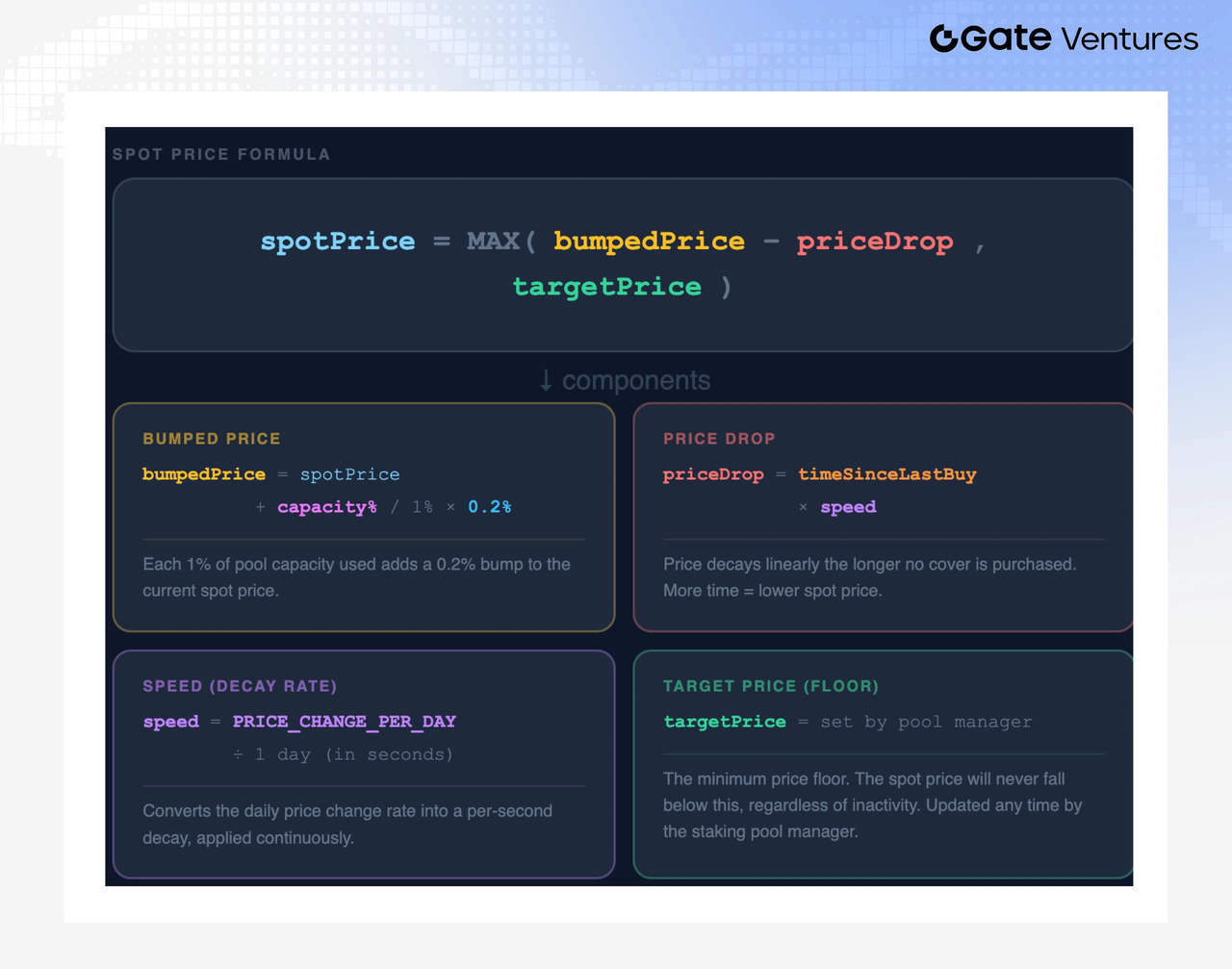

Pour la tarification du risque, les Covered Vaults utilisent le modèle dynamique de Nexus Mutual, et non un taux fixe.

En résumé, les souscripteurs fixent un taux minimal acceptable, puis ajustent les prix selon l’offre et la demande : si la demande de couverture sur un coffre explose et que la capacité de souscription est fortement sollicitée, les prix augmentent automatiquement ; à l’inverse, en cas de capacité excédentaire et de faible demande, les prix baissent progressivement. Il s’agit d’un mécanisme de tarification on-chain qui s’ajuste dynamiquement au risque et à l’utilisation du capital. (4)

Couche d’évaluation du risque

Plusieurs institutions se consacrent désormais à l’évaluation du risque DeFi, selon trois axes : notation de crédit, infrastructure de données vérifiables et simulation dynamique des paramètres. Ensemble, elles fournissent la base de la tarification de l’assurance et de la gestion du risque on-chain.

Credora s’apparente actuellement le plus aux agences de notation de crédit traditionnelles (telles que S&P et Moody’s) dans la DeFi, en proposant une notation quantitative du risque. Lancée par RedStone, Credora évalue de manière systématique les tokens, marchés de prêt et portefeuilles de coffres, fournissant aux protocoles des recommandations chiffrées pour l’allocation du capital.

Structure de notation à trois niveaux

1) Notation des tokens

Calcule la probabilité de défaut (PSL) pour des actifs comme les LST et stablecoins, à partir de méthodologies d’ancrage de référence et de facteurs d’ajustement du risque afin de générer des scores de risque de base.

2) Notation des marchés de prêt

Différencie les structures de marché :

Marchés à collatéral isolé (ex. Morpho) : Utilise des simulations Monte Carlo pour modéliser de nombreux scénarios aléatoires, estimant la distribution de probabilité des résultats — principalement pour évaluer si une défaillance de collatéral entraînerait des pertes significatives.

Marchés à collatéral mutualisé (ex. Aave, Spark) : Plus complexes, car les actifs peuvent être empruntés et réutilisés en collatéral, amplifiant le risque. L’accent est mis sur la possibilité qu’une défaillance d’actif sous-jacent amplifie le risque et affecte l’ensemble du marché. (5)

3) Notation des portefeuilles de stratégies

Considère les coffres comme des portefeuilles d’actifs inter-marchés, en intégrant non seulement l’allocation sous-jacente mais aussi la compétence du gestionnaire et la qualité de la gouvernance.

Méthodologie de notation

Source : Credora

Utilise un système de notation par lettres de A+ à D, mappé aux taux de défaut historiques (1990–2023) des trois principales agences. Une fonction exponentielle permet de construire la courbe PD, alignant les notations de crédit traditionnelles avec les distributions de risque DeFi.

Contrairement à Credora, LlamaRisk ne se concentre pas sur la notation mais sur la création d’un cadre de données de risque vérifiables on-chain — répondant au défi central de la fiabilité des données en DeFi.

Deux composantes clés

Cadre SAVE (Structured Attestation & Verification Engine)

Un kit open source TypeScript pour convertir des données financières structurées en enregistrements on-chain vérifiables, comprenant :

- Claims : Déclarations de faits structurées

- Proofs : Preuves cryptographiques

- Attestations : Preuves signées publiées on-chain et stockées sur IPFS

Applicable non seulement aux preuves de réserve mais aussi à la qualité des collatéraux et à la transparence des stratégies.

Suite LlamaGuard

Un ensemble d’outils de gestion du risque RWA bâtis sur SAVE :

- LlamaGuard Proof : Attestation automatisée de données financières

- LlamaGuard NAV : Oracle NAV borné basé sur Chainlink

- LlamaGuard Actions : Déclencheurs de réponse conditionnelle au risque (6)

Des protocoles comme Aave, Curve, Midas et Ethena utilisent ces outils pour obtenir des insights sur le risque, tels que la liquidité, les variations d’utilisation ou les écarts de prix d’oracle. Ces données aident les équipes à définir plus efficacement la taille des réserves, les plafonds d’endettement et d’autres paramètres de risque critiques.

Chaos Labs est l’une des plateformes d’analyse de risque DeFi les plus complètes, spécialisée dans la simulation en temps réel, les stress tests et l’optimisation des paramètres de risque.

Trois compétences clés

Premièrement, le suivi dynamique du risque : surveillance en temps réel des principaux indicateurs sur plusieurs blockchains, dont le total de l’offre et des volumes de prêt, les taux d’utilisation, les événements de liquidation, la concentration des collatéraux et l’exposition des adresses « baleines ». La plateforme suit actuellement plus de 63,7 milliards de dollars d’actifs sur les principales blockchains.

Deuxièmement, la simulation d’exposition au risque : stress tests pour des scénarios extrêmes, tels que des chutes brutales de prix des collatéraux, des contractions rapides de la liquidité ou des ventes massives d’actifs, afin d’évaluer la solvabilité d’un protocole et son risque de créances douteuses.

Troisièmement, l’optimisation des paramètres : sur la base des simulations, Chaos Labs formule des recommandations pour les principaux paramètres de risque — tels que LTV, seuils de liquidation, courbes de taux d’intérêt — aidant les protocoles à équilibrer efficacité du capital et gestion du risque. (7)

Couche de vérification

La couche de vérification répond à une question fondamentale : les données on-chain sont-elles réellement fiables ?

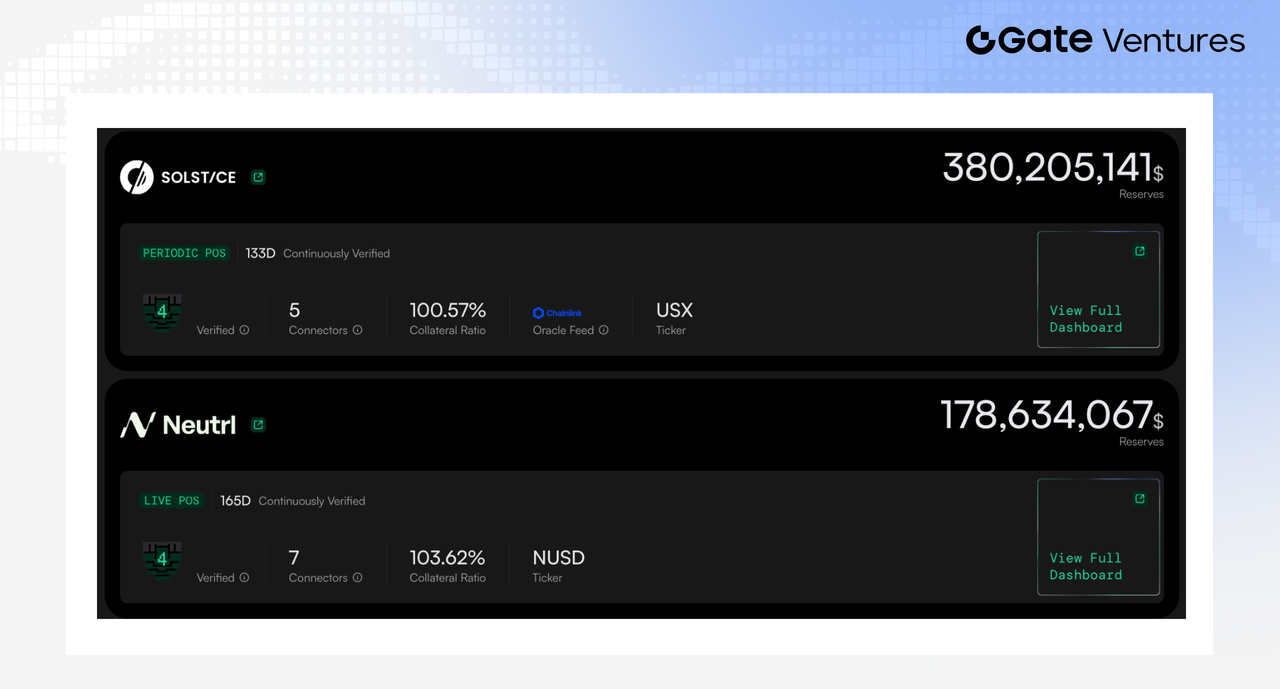

Sans mécanismes robustes de vérification des actifs, passifs et réserves, même les modèles de risque les plus sophistiqués peuvent reposer sur des hypothèses erronées. Les infrastructures de vérification les plus notables sont actuellement Chainlink Proof of Reserve et Accountable.

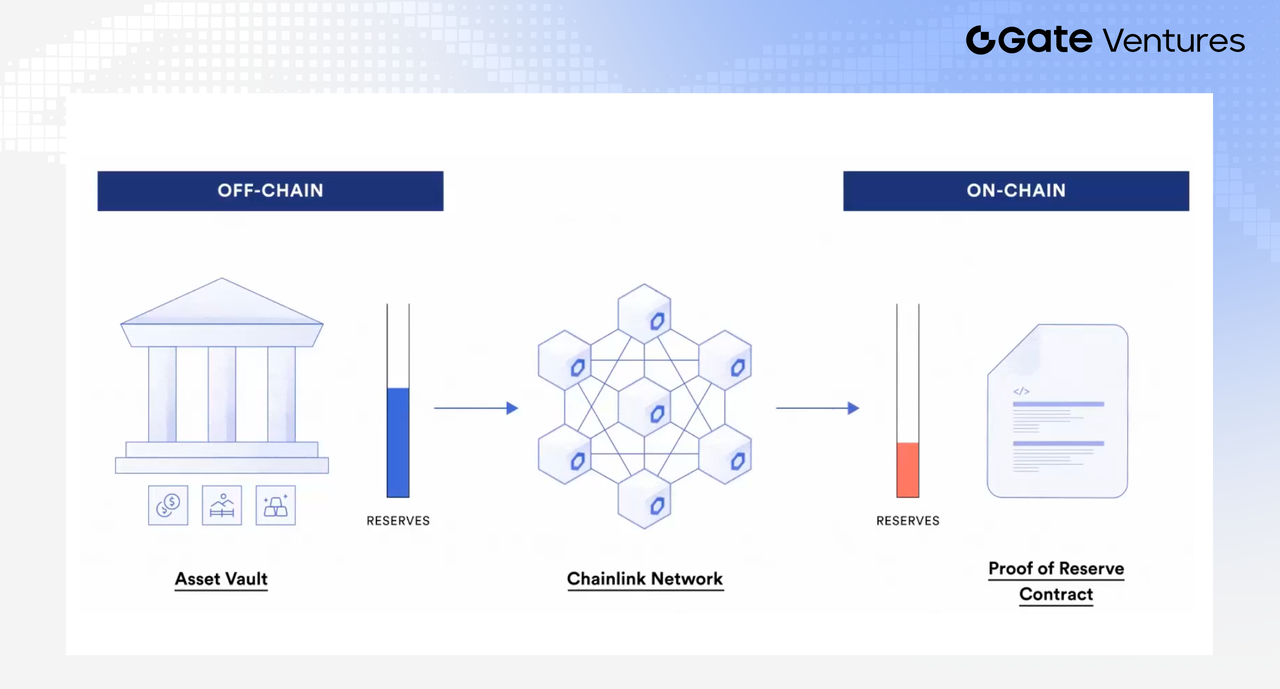

Chainlink PoR est l’un des réseaux de vérification de réserve on-chain les plus aboutis, utilisé principalement pour confirmer que les stablecoins, actifs cross-chain et RWA sont pleinement collatéralisés. Son objectif central est de réduire la dépendance de la DeFi à la confiance dans les actifs off-chain.

Source : Chainlink

Le processus implique généralement : des auditeurs ou fournisseurs de données collectent en continu les informations de réserve, qui sont ensuite vérifiées et validées par le réseau d’oracles décentralisé de Chainlink. Lorsque les réserves varient au-delà d’un seuil prédéfini ou à intervalles fixes, les données sont inscrites on-chain et accessibles directement par les protocoles. (8)

La valeur ajoutée de PoR réside dans son intégration directe à la logique des protocoles :

- Secure Mint : Autorise l’émission uniquement si les réserves sont suffisantes, empêchant l’émission non couverte

- Circuit Breaker : Met automatiquement en pause les opérations de prêt ou connexes en cas d’anomalie sur les collatéraux

Accountable Capital s’attaque à un angle mort fondamental du PoR traditionnel : la vérification des actifs sans celle des passifs.

Source : Accountable

Se concentrer uniquement sur les actifs ne suffit pas à prouver la santé d’une institution, qui pourrait dissimuler d’importants passifs. Accountable utilise des preuves à divulgation nulle de connaissance (ZKP) pour vérifier simultanément actifs et passifs sans exposer d’informations sensibles, offrant ainsi une preuve de solvabilité plus complète.

Fonctionnement

Son Data Verification Network (DVN) agrège en continu des données issues de multiples sources — adresses on-chain, comptes de conservation, comptes bancaires, registres internes, positions sur contrats. Après chiffrement local, il génère une ZKP attestant de la solvabilité nette de l’institution, sans révéler d’adresses, clés API ou stratégies de trading. (9)

Contrairement aux solutions qui vérifient seulement la présence de réserves, Accountable contrôle la santé financière globale — particulièrement utile pour les stratégies institutionnelles ou les structures de stablecoins devant divulguer en continu leur levier, couverture et passifs.

Couche de détection du risque

La couche de détection du risque répond à une autre question clé : peut-on détecter et stopper les attaques avant qu’elles ne causent des pertes ?

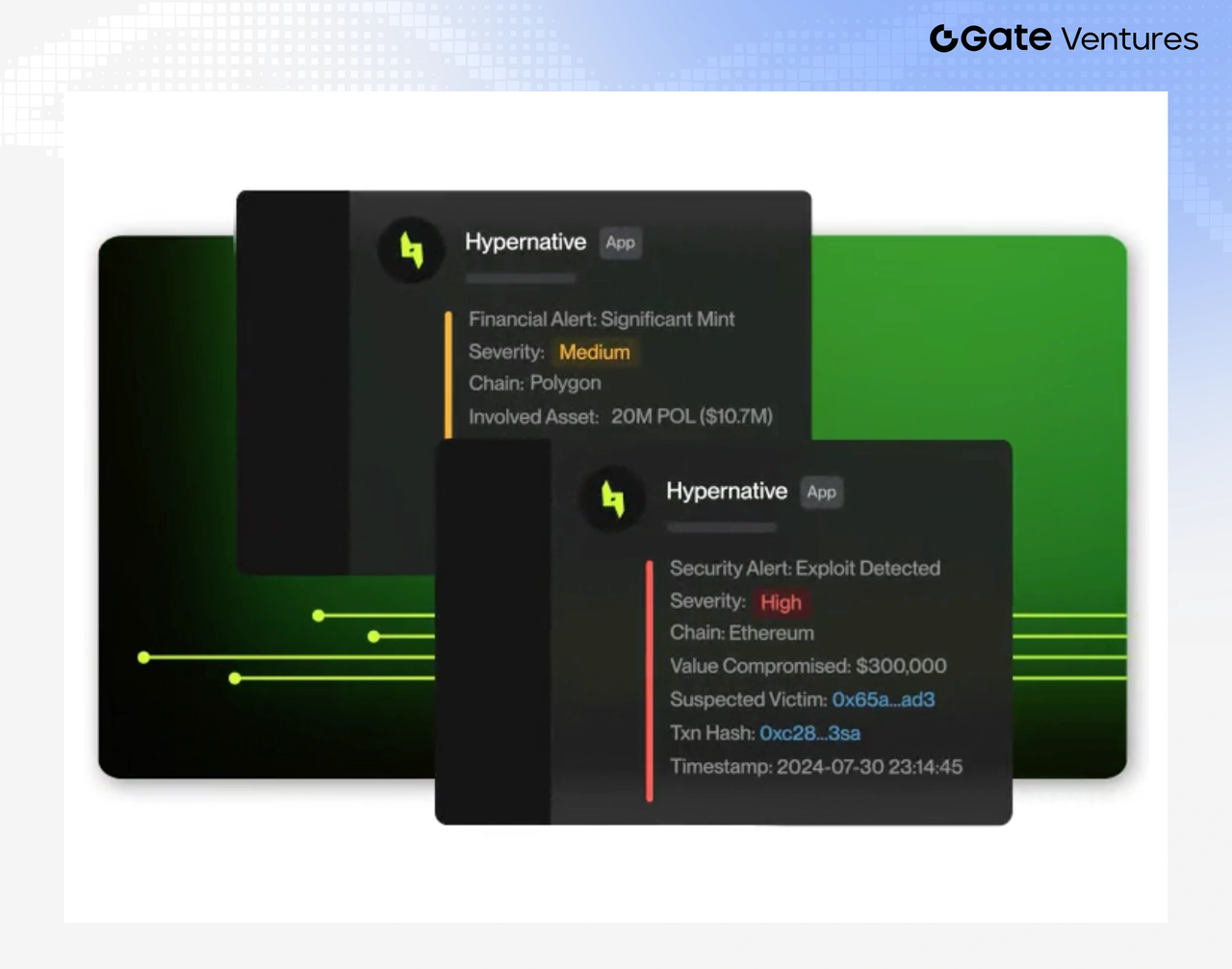

L’audit constitue une vérification statique avant déploiement, tandis que la couche de détection agit comme un « système immunitaire en temps réel » une fois le protocole en production. L’infrastructure la plus notable ici est Hypernative.

Source : Hypernative

Hypernative exploite le machine learning, la simulation de transactions, l’analyse de graphe et la surveillance du mempool pour suivre en continu les activités anormales sous différents angles. Autrement dit, il ne se contente pas de rechercher des vulnérabilités de contrat mais surveille la préparation d’attaques — chemins de transaction inhabituels, écarts d’oracle, actions de gouvernance anormales, phishing sur front-end ou comportements inter-protocoles. (10)

La valeur ajoutée de cette capacité de détection réside dans son intégration aux contrôles de risque automatisés. Lorsqu’un certain seuil de risque est atteint, le protocole peut immédiatement suspendre les marchés, geler certaines fonctions, ajuster les LTV ou plafonds d’emprunt, isoler les actifs suspects, voire intercepter les transactions avant leur inclusion dans un bloc.

Contrairement aux audits classiques, qui fournissent des rapports statiques avant lancement, ces systèmes offrent une protection continue et en temps réel : l’audit répond à « ce qui pourrait mal tourner », la détection à « est-ce qu’il se passe quelque chose d’anormal en ce moment ».

Perspectives

Pour que l’assurance DeFi puisse véritablement passer à l’échelle, plusieurs défis majeurs doivent être relevés.

Premièrement, le capital de souscription offre actuellement des rendements faibles, bien inférieurs à ceux d’autres opportunités on-chain. Qu’il s’agisse de prêt, de market making ou d’agrégation de rendement, le capital trouve souvent ailleurs des rendements supérieurs.

On revient ainsi à la loi de l’offre et de la demande : si la rémunération ajustée au risque des pools d’assurance n’est pas suffisante, qui fournira durablement le capital pour supporter ces risques extrêmes ?

Deuxièmement, pour que la couche d’assurance soit efficace, le pool de souscription doit être suffisamment important pour couvrir les pertes liées à des incidents de sécurité majeurs. Des événements extrêmes peuvent générer des pertes potentielles de plusieurs centaines de millions de dollars.

Bien entendu, la gestion du risque ne doit pas reposer uniquement sur l’assurance. Les protocoles doivent aussi mettre en place des mécanismes tels que timelocks et plafonds de retrait pour éviter que la liquidité ne soit drainée instantanément lors d’un incident. Malgré tout, les pools d’assurance doivent atteindre une taille suffisante pour offrir une protection significative.

Plus fondamentalement, comparée à la finance traditionnelle, la DeFi est confrontée à des incidents de sécurité plus fréquents et à une diversité accrue de vecteurs d’attaque — ce qui implique un besoin de capital de base encore plus important pour l’assurance, rendant le passage à l’échelle plus difficile.

Troisièmement, les protocoles DeFi actuels manquent de véritables « structures de limitation des pertes » au niveau de la conception système, ce qui rend difficile la tarification du risque par la couche d’assurance.

Du point de vue de l’assurance, la question clé n’est pas de savoir si des attaques surviendront, mais si les pertes peuvent être structurellement limitées lorsqu’elles surviennent. En pratique, de nombreux protocoles permettent encore aux administrateurs de déplacer de grandes sommes, modifier des paramètres ou même mettre à jour des contrats en un temps réduit. Une fois les permissions compromises, les pertes sont souvent « instantanément réalisées », avec un taux de perte en cas de défaut (LGD) proche de 100 %.

Dans ce contexte, les pools d’assurance souscrivent en réalité un risque extrême illimité — un risque quasiment impossible à commercialiser.

À l’inverse, si les protocoles intègrent :

- Des limites de taux de retrait

- Des plafonds de retrait par transaction/jour

- Des listes blanches de flux de fonds pré-approuvés

- Des timelocks obligatoires

Ils peuvent réduire significativement la perte maximale lors d’une attaque, transformant un risque « catastrophique » en risque « mesurable », et permettant une tarification rationnelle de l’assurance.

Quatrièmement, l’architecture technique sous-jacente de la DeFi recèle encore de nombreux « inconnus inconnus », exposant les protocoles on-chain à des surfaces d’attaque en constante évolution.

Des cas récents l’illustrent bien : la faille de Drift provenait d’un compromis de clé d’administration via ingénierie sociale, tandis que l’incident KelpDAO impliquait une défaillance critique du mécanisme de vérification 1-of-1. Lors de la réception de messages cross-chain via LayerZero, les fonds étaient débloqués sur la seule base de la vérification d’un nœud unique, créant un point de défaillance unique.

De tels risques ne découlent pas uniquement de bugs dans le code, mais peuvent provenir de la conception des permissions, de la validation cross-chain, de processus opérationnels ou d’erreurs humaines. En somme, les protocoles on-chain font face non seulement à des « risques connus », mais aussi à de nombreuses menaces potentielles encore non identifiées.

Même avec des plateformes comme Hypernative pour la surveillance en temps réel et des outils comme Chaos Labs et LlamaRisk pour l’évaluation du risque, le cadre de gestion du risque DeFi nécessitera encore plusieurs itérations avant d’atteindre une maturité et une fiabilité véritables.

https://www.swissre.com/institute/research/sigma-research.html#:~:text=Read Plus d’informations : sigma 03, 19 novembre 2024

À propos de Gate Ventures

Gate Ventures est la branche capital-risque de Gate, spécialisée dans l’investissement dans les infrastructures décentralisées, les écosystèmes et les applications, avec la mission de transformer le monde à l’ère du Web 3.0. Gate Ventures s’associe à des leaders mondiaux du secteur pour accompagner équipes et startups grâce à une vision et des capacités innovantes, redéfinissant l’interaction entre société et finance.

Pour plus d’informations, consultez : Site officiel | X | Telegram | LinkedIn | Medium

Avertissement :

Ce contenu ne constitue ni une offre, ni une sollicitation, ni un conseil de quelque nature que ce soit. Vous devez toujours solliciter un avis professionnel indépendant avant de prendre toute décision d’investissement. Veuillez noter que Gate Ventures peut restreindre ou interdire tout ou partie de ses services aux utilisateurs de certaines régions. Pour plus d’informations, veuillez consulter les Conditions d’utilisation ici : https://www.gate.com/fr/user-agreement.