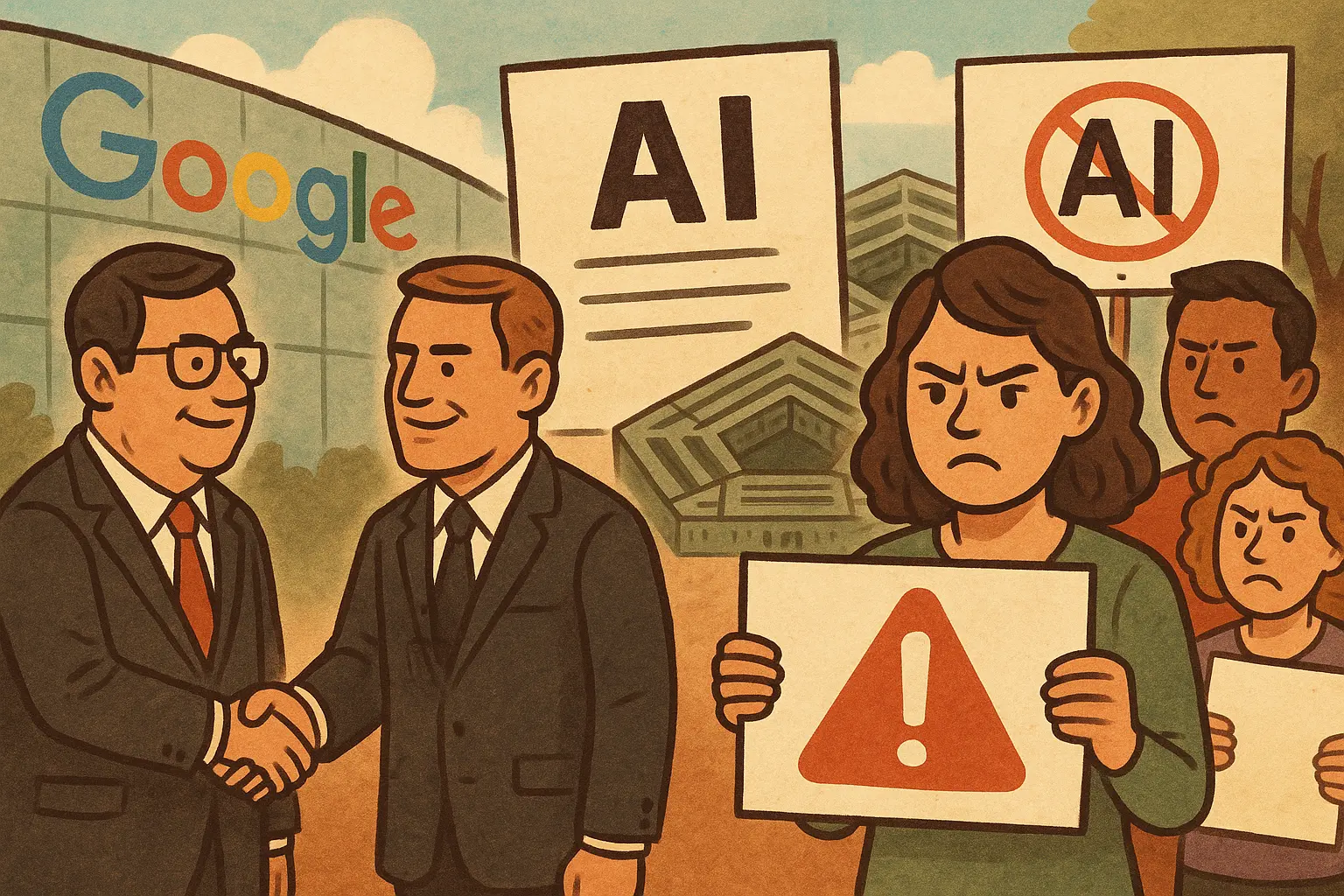

Google と国防総省が機密のAI協定に署名、従業員の公開書簡が反対

The Information が4月28日に報じたところによると、Googleは協議に署名しており、機密業務に使用するための人工知能(AI)モデルを米国防総省(五角大廈)に提供するという。ニューヨーク・タイムズが関係者の話として伝えたところでは、この協議により米国防総省は Google の AI を合法的な政府用途に使用できるようになるもので、先月、五角大廈が OpenAI および xAI と締結した機密AI 配備協議と同様の性質だという。

協議の内容と複数の当事者の背景

ニューヨーク・タイムズが関係者の話として伝えた報道によると、Google と五角大廈の協議は、国防総省(DoD)が機密業務において Google の AI モデルを使用できるようにするものだ。五角大廈は先月、OpenAI と xAI とそれぞれ同様の署名を完了し、機密ネットワーク上で AI モデルを配備できるようにしている。Google の協議は、五角大廈による AI 協力の拡大における最新の事例だ。

Google の広報担当者はニューヨーク・タイムズに対し、「私たちは、先進的な AI 実験室、技術およびクラウド企業から成る幅広い連合の一員になれて光栄です。国家安全保障に AI サービスとインフラを提供します。」と述べた。Decrypt はこの件について Google にコメントを求めたが、報道が出た時点で Google はまだ回答していない。

従業員による公開書簡:機密のワークロードを拒否するよう促す

ニューヨーク・タイムズの報道によれば、協議の署名前に数百人の Google 従業員が公開書簡に署名し、最高経営責任者(CEO)サンダー・ピチャイ(Sundar Pichai)に宛てて、同社が機密業務に AI システムを提供することに反対するよう促した。

公開書簡は、「私たちは、AI が人類に役立つことを望んでいます。人間にとって非人道的または極めて有害な用途に使われることは望んでいません。現時点で、Google がこの種の危害に関与しないための唯一の方法は、いかなる機密業務ワークロードも拒否することです。そうしなければ、この種の用途は、私たちが知らないうち、または止める力がない状態で起こり得ます。」と書いている。

書簡は、「致命的な自律型兵器と大規模監視」を主要な懸念として挙げ、「今、間違った決定を下せば、Google の評判、事業、そして世界における地位に取り返しのつかない損害を与える」と警告した。

国防総省の AI 統合プロセスと Anthropic の事例

ニューヨーク・タイムズの報道によると、米国防長官ピート・ヘグセス(Pete Hegseth)は、今年1月にイーロン・マスク(Elon Musk)の Starbase で行った講演で、「アメリカは21世紀の技術覇権における戦略的な競争に勝たねばならない」と述べ、さらに「私たちの部門のすべての非機密および機密ネットワークは、すぐに世界をリードする AI モデルを配備することになる」と語った。それ以降、国防総省は主要な AI 企業との合意に向けて歩みを速めている。

関連する背景として、報道によれば、国防総省は今年3月に Anthropic を「サプライチェーン・リスク」企業としてリストアップした。その理由は、Anthropic の CEO ダリオ・アモデイ(Dario Amodei)が、連邦政府による AI モデルの無制限の利用を認めることを拒否したためだという。Anthropic はその認定を受けて国防総省を提訴し、その後も他の政府部門との協力を継続することを求めている。

よくある質問

Google と五角大廈の機密 AI 協議はどのような用途を認めていますか?

ニューヨーク・タイムズが関係者の話として伝えたところによると、当該協議は、国防総省(DoD)が Google の AI を「あらゆる合法的な政府用途」に使用することを認めている。Google の広報担当者は、同社は AI が、無人の人工的な監督なしに、国内の大規模監視や自律型兵器に使われるべきではないとの立場を堅持していると述べた。

五角大廈は、どの AI 企業と類似の協議に署名していますか?

ニューヨーク・タイムズの報道によると、五角大廈は先月それぞれ OpenAI および xAI と、機密ネットワーク上で AI を配備することを認める協議に署名した。Google の協議は、この種の協力における同類事例の最新のものだ。

Anthropic は、類似の論点についてどのような立場ですか?

関連する報道によれば、国防総省は今年3月に Anthropic を「サプライチェーン・リスク」企業としてリストアップした。その理由は、Anthropic が、連邦政府による AI モデルの無制限の利用を認めることを拒否したためだという。Anthropic はその認定を受けて国防総省を提訴し、その後も他の政府部門との協力を継続することを求めている。

関連記事