DeepSeek V4-Pro は GPT-5.5 Pro より 98% 低コストでローンチ

DeepSeekは2026年4月24日にDeepSeek-V4-ProとDeepSeek-V4-Flashのプレビュー版をリリースしました。いずれも、100万トークンのコンテキストウィンドウを備えたオープンウェイトモデルであり、価格は比較対象となる欧米の代替品より大幅に低いものです。V4-Proモデルは、1,000,000件の入力トークンあたり$1.74、出力トークンあたり$3.48で、同社の公式仕様によれば、Claude Opus 4.7の約1/20の価格であり、GPT-5.5 Proより98%安いとのことです。

モデルアーキテクチャとスケール

DeepSeek-V4-Proは総パラメータ数1.6兆を特徴とし、これにより現時点でLLM市場における最大のオープンソースモデルとなっています。ただし、推論パスで実際に有効化されるのは490億パラメータのみです。DeepSeekがV3以降洗練させたMixture-of-Experts(MoE)アプローチを用いています。この設計により、モデル全体を休眠状態に保ちつつ、各リクエストに対して関連する部分のみが有効化されます。その結果、知識能力を維持しながら計算コストを削減できます。

DeepSeek-V4-Flashは、総パラメータ数2840億、アクティブパラメータ数130億と、より小規模で動作します。DeepSeekのベンチマークによれば、「より大きな思考予算を与えた場合、Pro版と同等の推論性能を達成する」とされています。

両モデルはいずれも、標準機能として100万トークンのコンテキストをサポートします。これはおよそ75万語、つまり「指輪物語」三部作全体に追加テキストを加えた規模に相当します。

技術革新:スケールにおける注意機構

DeepSeekは、長いコンテキスト処理に内在する計算のスケーリング問題に対処するため、同社の技術論文(GitHubで利用可能)で詳述されている2つの新しい注意(attention)タイプを発明しました。

標準的なAIの注意機構は苛烈なスケーリング問題に直面します。文脈長が2倍になるたびに、計算コストはおおむね4倍になるためです。DeepSeekの解決策は、2つの相補的なアプローチから成ります。

圧縮スパース注意(Compressed Sparse Attention) は2ステップで動作します。まず、トークンのグループを(例:4トークンごとに)1つのエントリに圧縮します。次に、全ての圧縮エントリに対して注意を向ける代わりに、「Lightning Indexer」を用いて、任意のクエリに対して最も関連性の高い結果だけを選択します。これにより、モデルの注意範囲は100万トークンから、はるかに小さい数の重要チャンクへと縮小されます。

強く圧縮された注意(Heavily Compressed Attention) は、より攻めたアプローチを取ります。スパースな選択なしで、128トークンごとを1つのエントリにまとめます。微細なディテールは失われますが、非常に安価なグローバルな俯瞰ビューを提供します。2つの注意タイプは交互の層で実行され、モデルが詳細と全体像の両方を維持できるようにします。

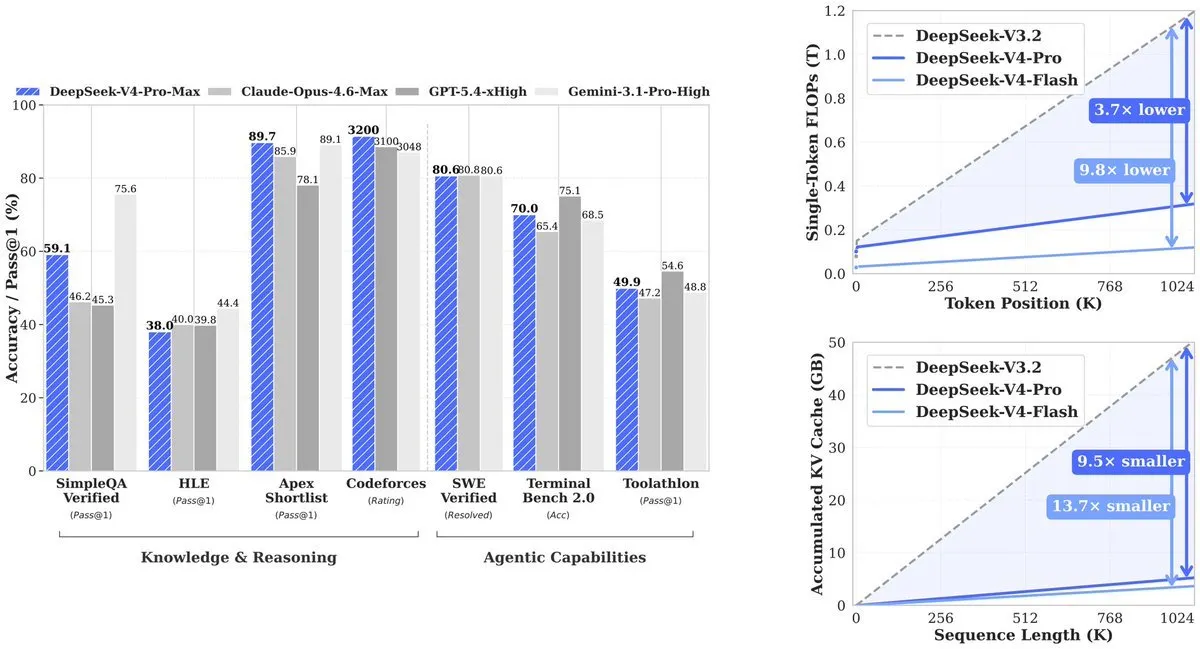

その結果、V4-Proは前身 (V3.2) が必要としていた計算の27%で済みます。KVキャッシュ(コンテキストを追跡するために必要なメモリ)はV3.2の10%に低下します。V4-Flashはさらに効率を押し進め、V3.2と比べて計算で10%、メモリで7%です。

ベンチマーク性能と競争上の位置づけ

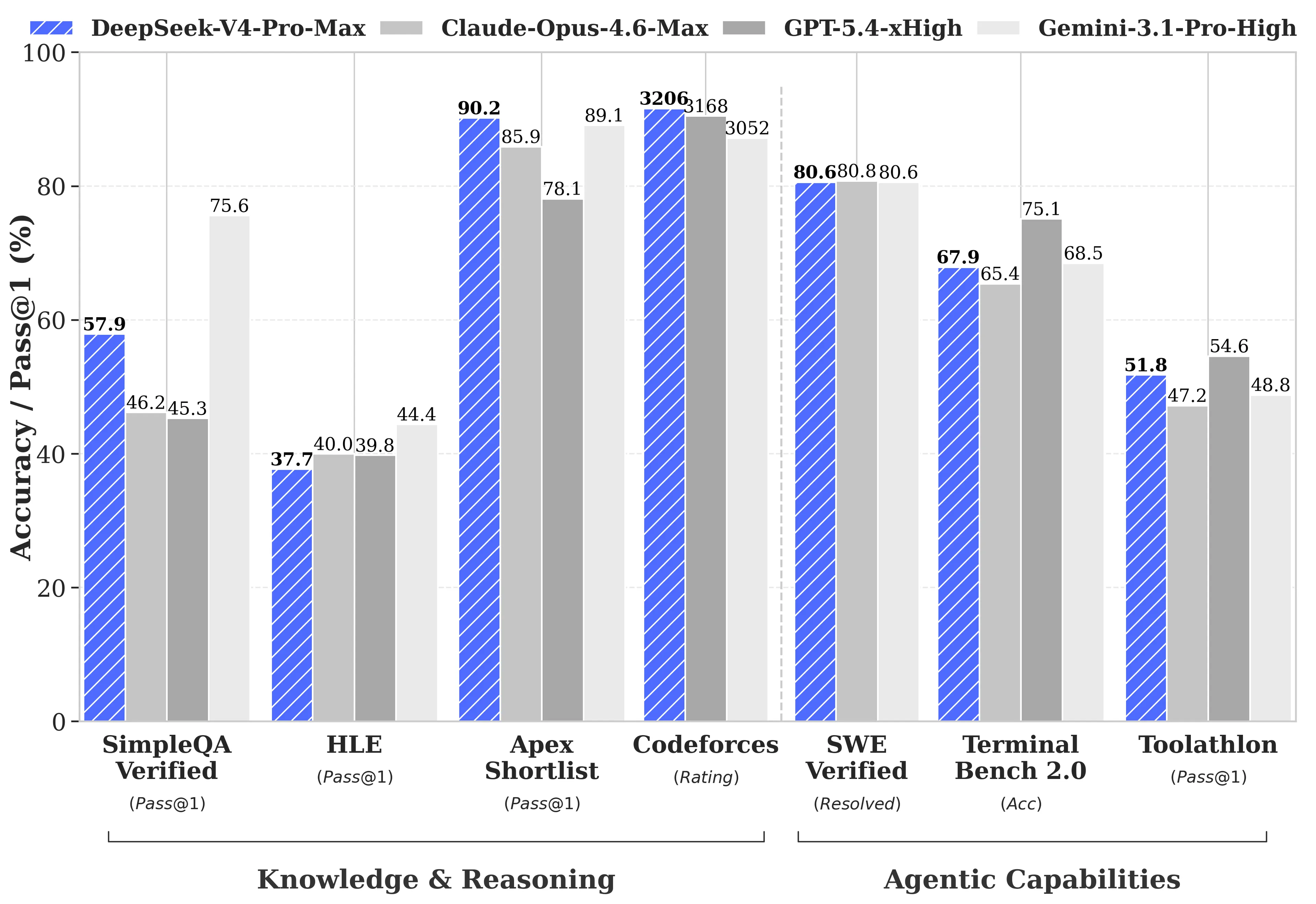

DeepSeekは、GPT-5.4およびGemini-3.1-Proに対する包括的なベンチマーク比較を公開しており、V4-Proが競合に劣る領域も含まれています。推論タスクでは、DeepSeekの技術レポートによれば、V4-Proの推論はGPT-5.4およびGemini-3.1-Proに対して約3〜6か月遅れています。

V4-Proがリードする領域:

- Codeforces (競技プログラミング):V4-Proは3,206点を獲得し、実際の人間によるコンテスト参加者の中で約23位

- Apex Shortlist (厳選された数学およびSTEM問題):Opus 4.6の85.9%およびGPT-5.4の78.1%に対し、90.2%の合格率

- SWE-Verified (GitHubのissue解決):80.6%で、Claude Opus 4.6の4.6

V4-Proが劣る領域:

- MMLU-Pro (マルチタスキング):Gemini-3.1-Proは91.0%であるのに対し、V4-Proは87.5%

- GPQA Diamond (専門知識):Geminiは94.3であるのに対し、V4-Proは90.1

- Humanity’s Last Exam (大学院レベル):Gemini-3.1-Proは44.4%であるのに対し、V4-Proは37.7%

長いコンテキストのタスクでは、V4-Proはオープンソースモデルで主導し、100万トークン時のCorpusQA (実文書解析をシミュレート)でGemini-3.1-Proに勝ちますが、長文テキストの奥深くに埋め込まれた特定情報の検索を測るMRCRではClaude Opus 4.6に負けます。

エージェンシックおよびコーディング能力

V4-ProはClaude Code、OpenCode、その他のAIコーディングツールで動作できます。DeepSeekの、V4-Proを主要なコーディングエージェントとして使用した85人の開発者に関する社内サーベイによれば、52%が「デフォルトモデルとして準備できている」と答え、39%が「はい寄り」とし、9%未満が「いいえ」と答えました。DeepSeekの社内テストでは、V4-ProがClaude Sonnetを上回り、エージェンシックなコーディングタスクではClaude Opus 4.5に迫ることが示されています。

Artificial Analysisは、GDPval-AAでV4-Proを全てのオープンウェイトモデルの中で1位にランク付けしました。これは、財務、法務、研究タスクにまたがる、経済的に価値のある知識作業を評価するベンチマークです。V4-Pro-Maxは1,554 Eloを獲得し、GLM-5.1 (1,535) とMiniMaxのM2.7 (1,514)に先行します。Claude Opus 4.6は同じベンチマークで1,619点です。

V4では「インターリーブド・シンキング」が導入され、ツール呼び出し間でも思考の完全なチェーンを維持します。従来のモデルでは、エージェントが複数のツール呼び出しを行う場合(たとえばWeb検索→コード実行→再度検索、のように)、モデルの推論コンテキストはラウンド間でフラッシュされていました。V4はステップ間で推論の連続性を維持し、複雑な自動化されたワークフローにおけるコンテキスト喪失を防ぎます。

競争環境と価格の文脈

V4リリースは、AI分野での大きな動きの中で到来します。Anthropicは2026年4月16日にClaude Opus 4.7を出荷しました。OpenAIのGPT-5.5は2026年4月23日にローンチされ、GPT-5.5 Proは $30 1,000,000件あたりの入力トークン$180 および (1,000,000件あたりの出力トークン)での価格設定です。GPT-5.5はTerminal Bench 2.0 (82.7% 対 70.0%) でV4-Proを上回ります。これは複雑なコマンドライン・エージェントのワークフローをテストするものです。

Xiaomiは2026年4月22日にMiMo V2.5 Proをリリースし、完全なマルチモーダル機能 $1 image, audio, video$3 を、(入力)および出力で各1,000,000トークンあたりの価格で提供しました。TencentはGPT-5.5と同じ日にHy3をリリースしました。

価格の見通しとして:ClineのCEO Saoud Rizwanは、もしUberがClaudeの代わりにDeepSeekを使っていたなら、その2026年のAI予算(報道によれば4か月分の利用に十分だった)は7年持ったはずだと指摘しました。

![Pricing comparison and Uber budget analysis]https://img-cdn.gateio.im/social/moments-0ee5a4bf95-cbc5686e31-8b7abd-badf29

配備と利用可能性

V4-ProとV4-Flashの両方はMITライセンスで、Hugging Faceで利用できます。両モデルは現時点ではテキストのみです。DeepSeekはマルチモーダル機能に取り組んでいると述べています。両モデルはローカルのハードウェアで無料で実行できますし、企業のニーズに基づいてカスタマイズすることもできます。

DeepSeekの既存のdeepseek-chatおよびdeepseek-reasonerのエンドポイントは、すでにそれぞれ、非思考モードおよび思考モードでV4-Flashにルーティングしています。旧来のdeepseek-chatおよびdeepseek-reasonerのエンドポイントは2026年7月24日に廃止されます。

DeepSeekはV4の一部をHuaweiのAscendチップで訓練しており、米国の輸出規制を回避しました。同社は、2026年後半に950の新しいスーパーノードが稼働すると、Proモデルのすでに低い価格がさらに下がると述べています。

実務上の含意

企業にとっては、価格構造が費用対効果の計算を変える可能性があります。1,000,000件の入力トークンあたり$1.74という価格でオープンソースのベンチマークをリードするモデルは、大規模なドキュメント処理、法務レビュー、コード生成パイプラインを、6か月前より大幅に安くできます。100万トークンのコンテキストにより、コードベース全体や規制関連の提出書類を、複数回の呼び出しに分割するのではなく、単一のリクエストとして処理できます。

開発者や個人のビルダーにとっては、V4-Flashが主な検討対象です。1,000,000トークンあたりの入力が$0.14、出力が$0.28であるため、1年前に「予算向け」とみなされていたモデルより安価で、Pro版が扱うほとんどのタスクをこなせます。