Anthropic Lança Claude Opus 4.7 Com Capacidades Cibernéticas Enfraquecidas

A Anthropic lançou uma versão melhorada do seu modelo de referência, Claude Opus 4.7, a 16 de abril (hora local). Comparado com o modelo Opus 4.6 anterior, o Opus 4.7 demonstra “melhorias significativas” nas capacidades avançadas de engenharia de software, sobretudo em tarefas difíceis, com maior rigor e consistência em operações complexas e de longa duração, além de capacidades de visão melhoradas. No entanto, a Anthropic enfraqueceu deliberadamente as capacidades de ataque-defesa em cibersegurança do modelo durante o treino e introduziu mecanismos de segurança para detetar e bloquear automaticamente pedidos proibidos ou de elevado risco.

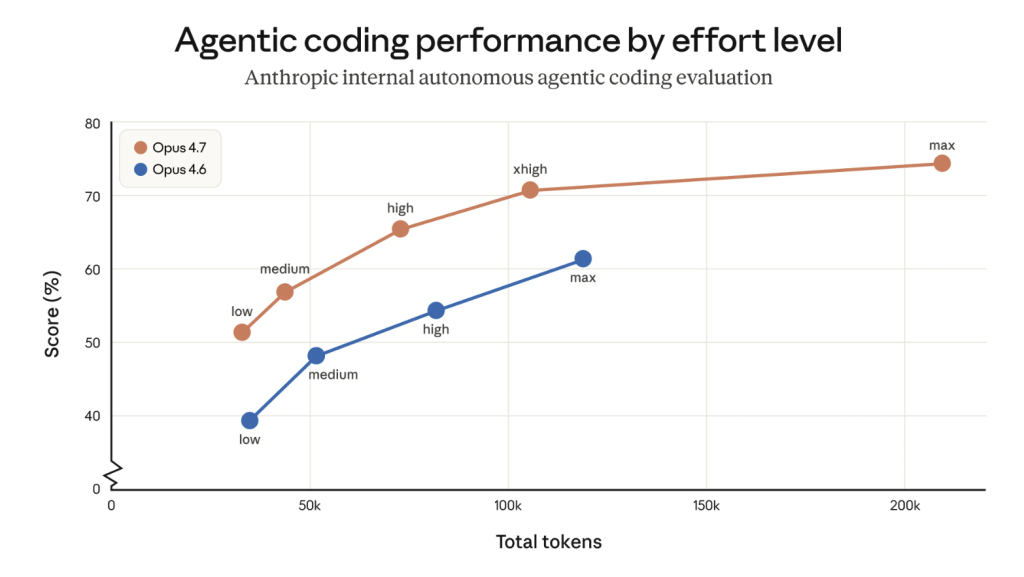

Desempenho e benchmarks

Nos testes de benchmark, o Opus 4.7 obteve pontuações, em geral, superiores às do Opus 4.6 anterior e do GPT-5.4 da concorrência. Ainda assim, a Anthropic salientou que as capacidades globais do Opus 4.7 não correspondem ao modelo mais poderoso da empresa, o Claude Mythos Preview. Segundo a Anthropic: “Ao implementar e operar estes mecanismos de proteção no mundo real, iremos acumular experiência para, no final, permitir uma disponibilização mais ampla de modelos ao nível do Mythos.”

Implementação e preços

O Opus 4.7 já está ativo em todos os produtos e interfaces de API da Claude, integrado com os serviços Amazon Bedrock, Google Cloud Vertex AI e Microsoft Foundry. A estrutura de preços mantém-se igual à do Opus 4.6: $5 por cada milhão de tokens de entrada e $25 por cada milhão de tokens de saída.

Alterações no consumo de tokens

Duas alterações no Opus 4.7 face ao Opus 4.6 afetarão o uso de tokens. Primeiro, o Opus 4.7 utiliza um tokenizador atualizado, melhorando a forma como o modelo processa texto. No entanto, isto significa que entradas idênticas poderão consumir mais tokens—aproximadamente 1 a 1,35 vezes o consumo da geração anterior.

Em segundo lugar, o Opus 4.7 realiza mais raciocínio com maior “intensidade de pensamento”, em particular nas rondas subsequentes de cenários agentícos. Isto melhora a fiabilidade em problemas complexos, mas gera tokens de saída adicionais.

- Aumento no consumo de tokens do Opus 4.7. Fonte: Anthropic *

Análise de mercado e contexto

Analistas descrevem o Opus 4.7 como um modelo “transitório”. O analista de investimento Adam Button observou que o lançamento do Opus 4.7 reforça a narrativa da Anthropic em torno de “modelos divinos” como o Mythos e confirma o ceticismo do mercado: os modelos pagos disponíveis publicamente são, essencialmente, versões “lite” limitadas por mecanismos de segurança.

Contexto da empresa e marco financeiro

A Anthropic, fundada em 2021 por antigos colaboradores da OpenAI, desenvolve a série de modelos de linguagem Claude. A 6 de abril, a Anthropic anunciou que a sua receita anualizada (ARR) excedeu $300 mil milhões, um aumento significativo face aos $9 mil milhões no final de 2025. A empresa está a prosseguir ativamente com uma oferta pública inicial.

Preocupações com risco de cibersegurança

Os executivos da Anthropic têm, repetidamente, alertado para o impacto da IA na cibersegurança. De acordo com relatórios datados de 10 de abril (hora local), a secretária do Tesouro dos EUA Yellen e o presidente da Reserva Federal Powell realizaram uma reunião de emergência com líderes de Wall Street a 7 de abril para discutir como o mais recente modelo de IA Mythos da Anthropic poderia aumentar os riscos de cibersegurança. A Anthropic afirmou que o Mythos não é adequado para lançamento público porque o modelo poderia ser mal utilizado por cibercriminosos e por espiões. A empresa está a fornecer acesso ao Mythos de forma seletiva a empresas globais líderes em cibersegurança e software.

Related Articles

DeepSeek Procura Financiamento de 1,8 mil milhões de dólares a uma Valorização de $20B em Meio a uma Fuga de Talentos

Juiz rejeita alegações de fraude no processo de Elon Musk contra a OpenAI; caso avança para julgamento com duas alegações remanescentes

O CEO da OpenAI, Sam Altman, pede desculpa por não ter denunciado às autoridades a conta banida do atirador da escola

Os EAU Anunciam uma Mudança Para um Modelo de Governo Baseado em IA nos Próximos Dois Anos

Plataforma de Negociação com IA Fere AI Angaria $1,3M em Financiamento Liderado pela Ethereal Ventures

A Google acrescenta mais 40 mil milhões de dólares de investimento na Anthropic: primeiro paga 10 mil milhões, depois liberta 30 mil milhões consoante o desempenho, com capacidade de computação de 5GW de TPU