DeepSeek V4-Pro 以比 GPT-5.5 Pro 低 98% 的成本发布

DeepSeek 在 2026 年 4 月 24 日发布了 DeepSeek-V4-Pro 和 DeepSeek-V4-Flash 的预览版本,这两款都是开放权重模型,拥有一百万 token 的上下文窗口,并且定价显著低于可比的西方替代方案。根据该公司官方规格说明,V4-Pro 模型的费用为每百万输入 token $1.74、每百万输出 token $3.48——大约是 Claude Opus 4.7 价格的 1/20,并且比 GPT-5.5 Pro 低 98%。

模型架构与规模

DeepSeek-V4-Pro 具备 1.6 万亿(trillion)个总参数,使其成为迄今为止 LLM 市场中最大的开源模型。然而,每次推理时只有 490 亿个参数会激活,使用的是 DeepSeek 所称的 Mixture-of-Experts(混合专家)方案,并且该方案自 V3 以来不断精炼。该设计使得整个模型保持休眠状态,而仅对任何给定请求激活相关的切片,从而降低计算成本,同时维持知识能力。

DeepSeek-V4-Flash 以更小的规模运行,总参数为 2840 亿,激活参数为 130 亿。根据 DeepSeek 的基准测试,它“在给予更大的思考预算时,实现了与 Pro 版本相当的推理性能”。

这两款模型都支持一百万 token 的上下文,作为标准功能——大约 750,000 个词,或大致相当于《指环王》三部曲的全部内容,再加上一些额外文本。

技术创新:规模化的注意力机制

DeepSeek 通过发明两种新的注意力类型来解决长上下文处理固有的计算扩展问题,具体细节如公司在 GitHub 上提供的技术论文所述。

标准的 AI 注意力机制面临一个残酷的扩展问题:每当上下文长度加倍,计算成本就会大约增加四倍。DeepSeek 的解决方案包含两个互补的思路:

压缩稀疏注意力(Compressed Sparse Attention) 分两步进行。它首先压缩 token 分组——例如把每 4 个 token 压缩成一个条目。然后,它并不对所有压缩后的条目进行注意力计算,而是使用“Lightning Indexer(闪电索引器)”来为任意给定查询只选择最相关的结果。这样会把模型的注意力范围从一百万 token 缩减到一小批更重要的代码块。

重度压缩注意力(Heavily Compressed Attention) 采用更激进的方法,在不进行稀疏选择的情况下,把每 128 个 token 折叠成一个条目。尽管这会丢失更细粒度的细节,但它能提供一种极其便宜的全局视角。两种注意力类型在交替的层中运行,使模型能够同时保留细节与概览。

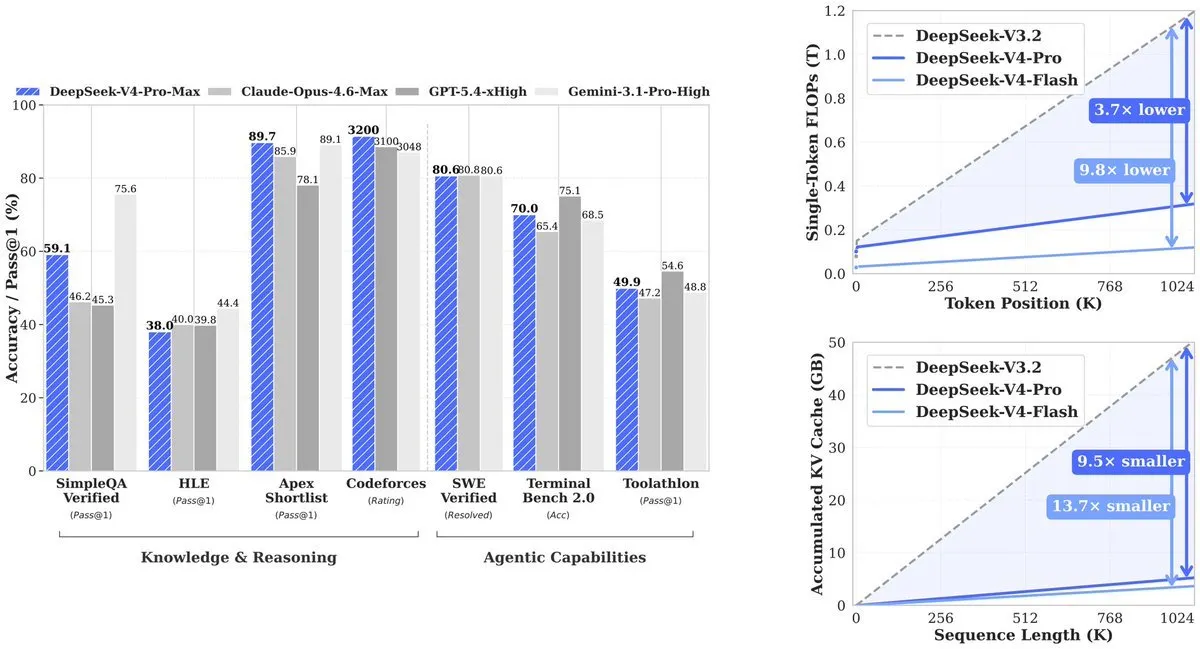

结果:V4-Pro 使用其前身所需计算量的 27% (V3.2)。KV cache——用于跟踪上下文所需的内存——降至 V3.2 的 10%。V4-Flash 进一步提升效率:相较于 V3.2,计算为 10%,内存为 7%。

基准性能与竞争地位

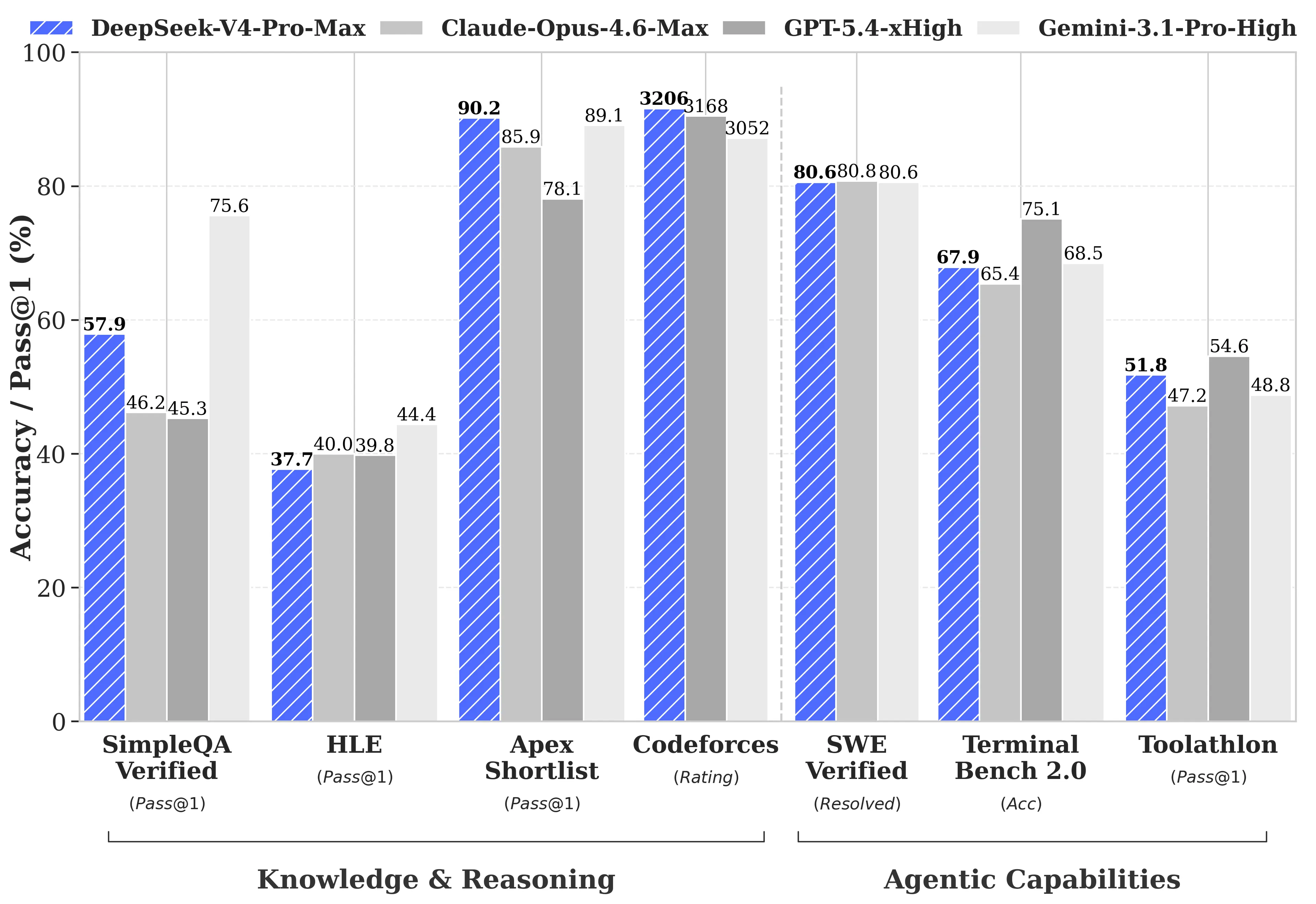

DeepSeek 发布了针对 GPT-5.4 和 Gemini-3.1-Pro 的全面基准对比,包括 V4-Pro 落后竞争对手的领域。在推理任务上,根据 DeepSeek 的技术报告,V4-Pro 的推理能力比 GPT-5.4 和 Gemini-3.1-Pro 大约落后三到六个月。

V4-Pro 领先之处:

- Codeforces (竞赛式编程):V4-Pro 得分 3,206,在真实的人类竞赛参赛者中大约排名第 23 位

- Apex Shortlist (精选的数学与 STEM 题目):90.2% 的通过率,相比 Opus 4.6 的 85.9% 和 GPT-5.4 的 78.1%

- SWE-Verified (GitHub 议题解决):80.6%,与 Claude Opus 4.6 的表现一致

V4-Pro 落后之处:

- MMLU-Pro (多任务):Gemini-3.1-Pro 为 91.0%,而 V4-Pro 为 87.5%

- GPQA Diamond (专家知识):Gemini 为 94.3,而 V4-Pro 为 90.1

- Humanity’s Last Exam (研究生级别):Gemini-3.1-Pro 为 44.4%,而 V4-Pro 为 37.7%

在长上下文任务上,V4-Pro 领先开源模型,并且在 CorpusQA (模拟真实文档分析(上下文为一百万 token)) 上击败 Gemini-3.1-Pro,但在 MRCR 上落后于 Claude Opus 4.6;MRCR 衡量的是在长文本深处检索特定信息的能力。

Agentic 与编码能力

V4-Pro 可以在 Claude Code、OpenCode 以及其他 AI 编码工具中运行。根据 DeepSeek 对 85 位把 V4-Pro 作为主要编码代理的开发者所做的内部调查,52% 的人表示它已经准备好成为他们的默认模型,39% 的人倾向于“是”,少于 9% 的人表示“否”。DeepSeek 的内部测试显示,V4-Pro 在 agentic 编码任务上优于 Claude Sonnet,并接近 Claude Opus 4.5。

Artificial Analysis 在 GDPval-AA 上将 V4-Pro 排在所有开放权重模型中的第一位;GDPval-AA 是一个基准,用于测试在金融、法律与研究任务中具有经济价值的知识工作。V4-Pro-Max 的 Elo 分数为 1,554,高于 GLM-5.1 (1,535) 和 MiniMax 的 M2.7 (1,514)。在同一基准上,Claude Opus 4.6 的得分为 1,619。

V4 引入“交错式思考(interleaved thinking)”,能够在工具调用之间保留完整的思维链。在此前的模型中,当代理进行了多次工具调用——例如先搜索网络、再运行代码、随后再次搜索——模型的推理上下文会在各轮之间被清空。V4 在步骤之间保持推理连续性,防止在复杂的自动化工作流中出现上下文丢失。

竞争格局与定价背景

V4 的发布正值 AI 领域出现显著的活跃态势。Anthropic 于 2026 年 4 月 16 日发布了 Claude Opus 4.7。OpenAI 于 2026 年 4 月 23 日推出了 GPT-5.5;其中 GPT-5.5 Pro 的定价为 $30 每百万输入 token 的价格$180 以及 (每百万输出 token 的价格)。根据用于测试复杂命令行代理工作流的 Terminal Bench 2.0,GPT-5.5 在该基准上击败 V4-Pro:(82.7% 对比 70.0%)。

小米于 2026 年 4 月 22 日发布 MiMo V2.5 Pro,提供完整的多模态能力 $1 image, audio, video$3 ,其 (每百万 token 的输入) 与 每百万 token 的输出 定价分别为上述数值。腾讯在 GPT-5.5 发布的同一天发布了 Hy3。

从定价视角来看:Cline 的 CEO Saoud Rizwan 指出,若 Uber 使用 DeepSeek 而不是 Claude,那么其 2026 年的 AI 预算(据称足够使用四个月)本可持续七年。

![Pricing comparison and Uber budget analysis]https://img-cdn.gateio.im/social/moments-0ee5a4bf95-cbc5686e31-8b7abd-badf29

部署与可用性

V4-Pro 和 V4-Flash 均采用 MIT 许可,并可在 Hugging Face 上获取。这些模型目前仅支持文本;DeepSeek 表示正在开发多模态能力。两款模型都可以在本地硬件上免费运行,或者根据公司需求进行定制。

DeepSeek 现有的 deepseek-chat 与 deepseek-reasoner 端点已经分别在非思考模式与思考模式下路由到 V4-Flash。旧的 deepseek-chat 与 deepseek-reasoner 端点将于 2026 年 7 月 24 日退役。

DeepSeek 的训练中,V4 部分使用了华为 Ascend 芯片,从而规避了美国的出口限制。公司表示,等到 2026 年后期上线 950 个新的超级节点,Pro 模型已然很低的价格还将进一步下调。

实际影响

对于企业而言,定价结构可能会改变成本—收益的计算方式。以每百万输入 token $1.74 的价格在开源基准上领先,使得大规模文档处理、法律审查以及代码生成流水线,比六个月前便宜得多。一百万 token 的上下文允许整个代码库或监管文件在单次请求中被处理,而不是在多次调用中切块处理。

对于开发者与独立构建者而言,V4-Flash 是主要考虑对象。以每百万输入 token $0.14、每百万输出 token $0.28 的价格计算,它比一年前被视为“预算选项”的模型更便宜,同时还能处理 Pro 版本所能覆盖的大多数任务。