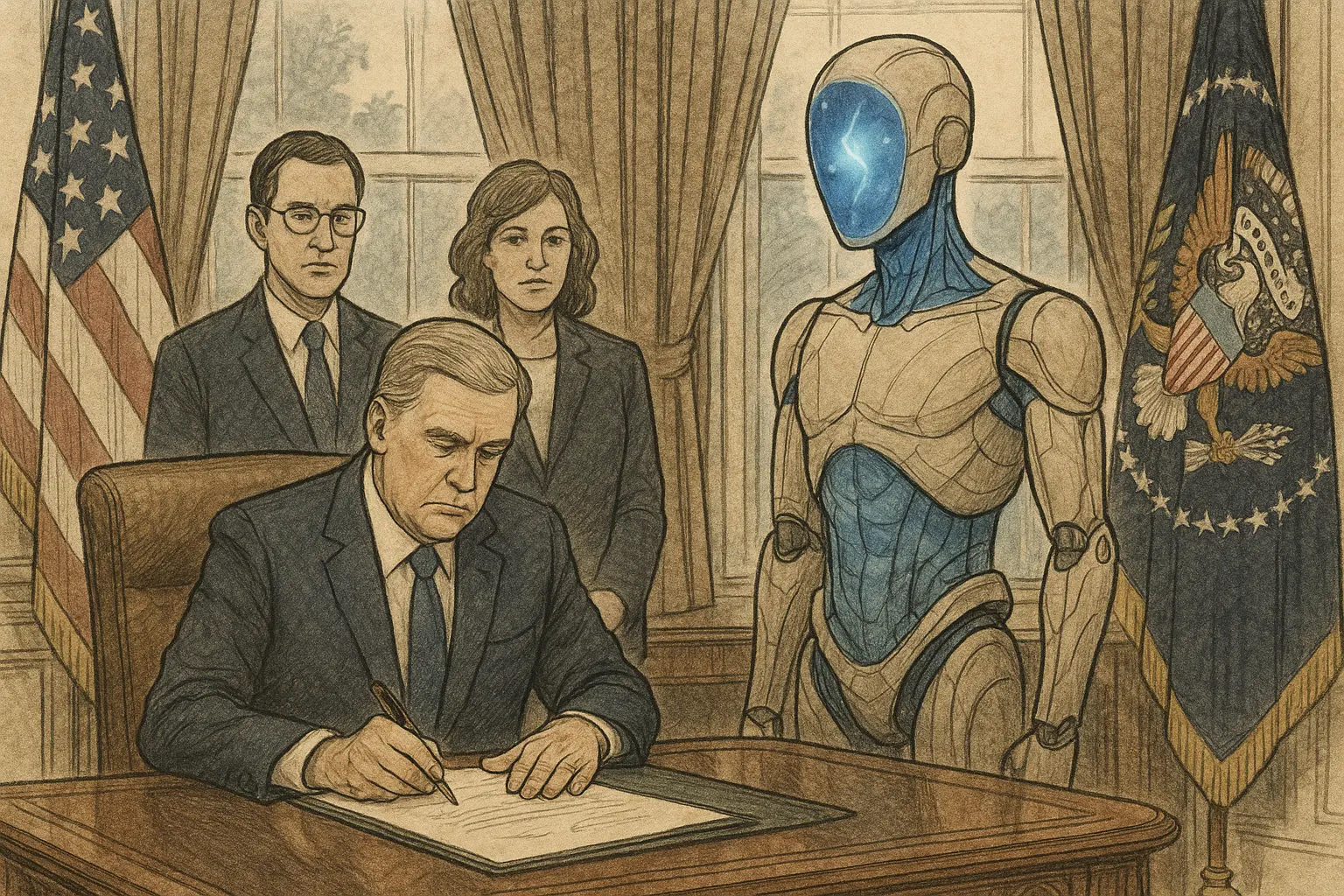

СМИ США: проект административного указа Белого дома разрешает модели Anthropic Mythos войти в государственные структуры

Согласно отчету, цитирующему источники от 28 апреля со стороны Axios, Белый дом разрабатывает руководящие указания, позволяющие всем федеральным ведомствам обходить оценку рисков поставок (SCRD) Anthropic, а также вводит новые модели для использования правительством, включая модель Mythos от Anthropic. В этой связи Белый дом опубликовал официальное заявление, в котором говорится, что любые заявления о политике будут опубликованы непосредственно президентом, а любые другие версии — не более чем предположения.

Недавние контакты Белого дома и предложенные меры

Согласно отчету Axios от 28 апреля, в начале этого месяца руководитель аппарата Белого дома Сьюзи Уайлс (Susie Wiles) и министр финансов Скотт Бессент (Scott Bessent) совместно встретились с генеральным директором Anthropic Дарийо Амодеи (Dario Amodei), и обе стороны охарактеризовали эту встречу как результативную ознакомительную сессию, на которой обсуждались направления сотрудничества компании с правительством.

На этой неделе Белый дом созвал представителей компаний из разных отраслей, чтобы предоставить информацию о потенциальных административных мерах и лучших практиках при развертывании системы Mythos. Согласно сообщению Axios, соответствующие встречи включали «читки сценария» (table reads) предложенных руководящих указаний; эти указания могут отменить ранее выпущенную директиву Управления по вопросам управления и бюджета (OMB) о том, что правительственным департаментам нельзя использовать системы Anthropic. Anthropic отказалась комментировать соответствующий материал Axios.

Предыстория спора: оценка рисков поставок и судебный иск Пентагона

Согласно отчету Axios от 28 апреля, ранее Пентагон (DoD) уже выпустил оценку рисков поставок по Anthropic и подал иск в суд. Суть спора заключается в том, что Anthropic отказалась подписывать соглашение, позволяющее Пентагону использовать модель Claude по стандарту «все законные способы применения» (включая применения для беспилотников); в явных запретительных положениях Anthropic, помимо прочего, предусмотрены массовая внутренняя слежка и разработка полностью автономного оружия. Пентагон заявил, что отказ Anthropic демонстрирует, что она не является надежным партнером.

Согласно сообщению Axios, несмотря на продолжающееся судебное разбирательство, включая Пентагон, правительственные структуры все еще могут использовать некоторые модели Anthropic, а Агентство национальной безопасности США (NSA) также использует Mythos. Однако Пентагон сейчас придерживается прежних версий условий обслуживания, которые обе стороны считают чрезмерно строгими, и не может получить последние обновленные версии моделей Anthropic.

Базовая позиция Anthropic и сравнение с другими компаниями

Согласно сообщению Axios от 28 апреля, Anthropic настаивает на отказе подписывать соглашение «все законные способы применения» и прямо запрещает, в том числе, массовую внутреннюю слежку и разработку полностью автономного оружия.

Axios также указывает, что и OpenAI, и Google уже подписали соглашения с Пентагоном, позволяющие использовать их модели по стандарту «все законные способы применения» в условиях конфиденциальной среды; обе компании заявляют, что соответствующие соглашения соблюдают два пункта запрета, установленные Anthropic.

Часто задаваемые вопросы

Каково конкретное содержание связанных с Anthropic руководящих указаний, которые, как предполагается, собирается разработать Белый дом?

Согласно отчету Axios от 28 апреля со ссылкой на осведомленные источники, Белый дом разрабатывает руководящие указания, позволяющие федеральным ведомствам обходить оценку рисков поставок Anthropic; соответствующие меры могут быть опубликованы в форме указа, и они включают инструкции по развертыванию модели Mythos. В официальном заявлении Белого дома говорится, что любые заявления о политике будут опубликованы непосредственно президентом.

Какова первопричина спора между Пентагоном и Anthropic?

Согласно отчету Axios от 28 апреля, спор начался с отказа Anthropic подписать соглашение, позволяющее Пентагону использовать модель Claude по стандарту «все законные способы применения»; в явных запретительных вариантах применения указаны массовая внутренняя слежка и разработка полностью автономного оружия. После этого Пентагон выпустил оценку рисков поставок и подал судебный иск.

Какова позиция OpenAI и Google по этому же вопросу?

Согласно сообщению Axios от 28 апреля, и OpenAI, и Google уже подписали соглашения с Пентагоном, позволяющие использовать их модели по стандарту «все законные способы применения» в условиях конфиденциальной среды, и обе компании заявляют, что соглашения соблюдают два пункта запрета, установленные Anthropic.

Related News

CFTC подает иск против Висконсина, в течение одного месяца предъявляет обвинения в 5 штатах, отстаивая юрисдикцию прогнозных рынков

Смена власти в Федеральной резервной системе: интрига усиливается — разногласия по политике Уоша, анализ рисков независимости и траектории балансового отчёта

Google заключила конфиденциальный контракт на ИИ с Пентагоном, сотни сотрудников подписали петицию против, но это не дало результата

Gate日报(4月28日):白宫暗示战略比特币储备“重大公告”;以色列批准谢克尔挂钩稳定币

Агент Cursor AI всё испортил! Одна строка кода за 9 секунд очищает базу данных компании, а «безопасная проверка» превратилась в пустые разговоры