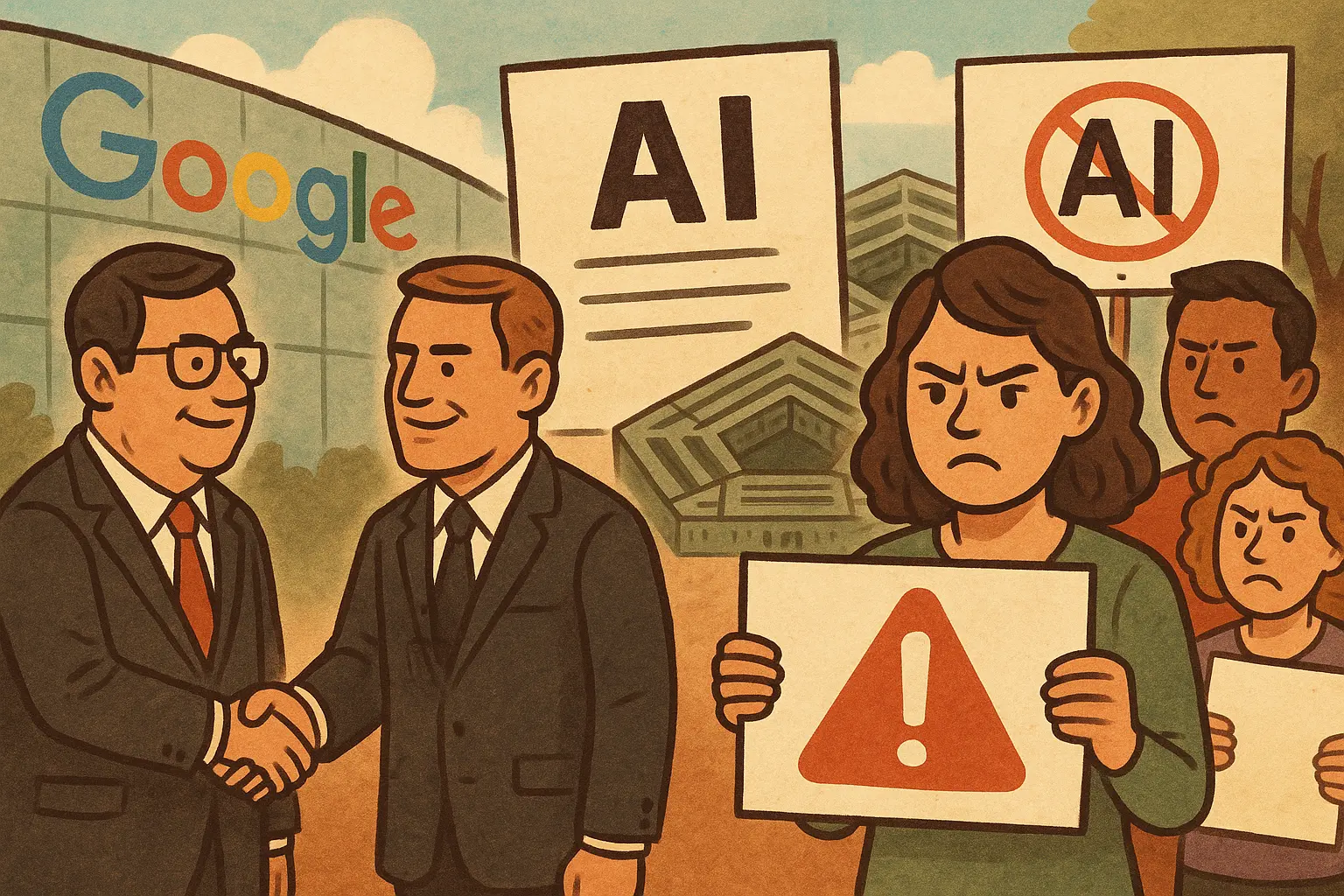

Google y el Pentágono firman un acuerdo de IA confidencial; empleados publican una carta abierta en contra

De acuerdo con The Information en un reporte del 28 de abril, Google ha firmado un acuerdo para proporcionar a Estados Unidos el Pentágono modelos de inteligencia artificial (IA) para trabajos confidenciales. The New York Times, citando a personas familiarizadas con el asunto, indicó que el acuerdo permite al Departamento de Defensa utilizar la IA de Google para fines gubernamentales legítimos, con una naturaleza similar al acuerdo de despliegue de IA confidencial que el Pentágono firmó el mes pasado con OpenAI y xAI.

Contenido del acuerdo y antecedentes de múltiples partes

Según un reporte del New York Times citando a personas familiarizadas con el asunto, el acuerdo entre Google y el Pentágono permite al DoD utilizar los modelos de IA de Google en trabajos confidenciales. El Pentágono ya ha completado el mes pasado firmas similares con OpenAI y xAI, permitiendo desplegar modelos de IA en redes confidenciales; el acuerdo de Google es el caso más reciente en el que el Pentágono amplía su cooperación en IA.

Un portavoz de Google le dijo al New York Times: «Nos sentimos honrados de ser parte de una amplia coalición compuesta por laboratorios líderes de IA, empresas tecnológicas y de nube, para brindar servicios de IA e infraestructura en apoyo a la seguridad nacional». Decrypt contactó a Google para solicitar comentarios al respecto; al momento de la publicación del reporte, Google no había respondido.

Carta abierta de empleados: instan a rechazar cargas de trabajo confidenciales

Según un reporte del New York Times, antes de que se firmara el acuerdo, cientos de empleados de Google ya habían firmado una carta abierta, dirigida al CEO Sundar Pichai, instando a la empresa a no proporcionar al Pentágono sistemas de IA para trabajos confidenciales.

La carta abierta decía: «Esperamos que la IA beneficie a la humanidad, y no que se use para fines inhumanos o extremadamente dañinos. Actualmente, la única forma de garantizar que Google no se vincule con este tipo de daños es rechazar cualquier carga de trabajo confidencial. De lo contrario, estos usos podrían ocurrir sin que nosotros lo sepamos o sin que podamos impedirlos».

En la carta se enumeran «armas autónomas letales y vigilancia a gran escala» como principales preocupaciones, y advierte que «tomar ahora una decisión equivocada causará un daño irreversible a la reputación, los negocios y la posición mundial de Google».

Proceso de integración de IA del Pentágono y caso de Anthropic

De acuerdo con un reporte del New York Times, el Secretario de Defensa Pete Hegseth dijo en un discurso en enero de este año en Starbase de Elon Musk que: «Estados Unidos debe ganar la competencia estratégica por la supremacía tecnológica del siglo XXI», y afirmó: «Cada una de nuestras redes no confidenciales y confidenciales del departamento desplegará muy pronto modelos de IA líderes en el mundo». Desde entonces, el Pentágono ha acelerado los pasos para llegar a acuerdos con las principales empresas de IA.

En cuanto a los antecedentes, según reportes relacionados, en marzo de este año el Pentágono catalogó a Anthropic como una empresa de «riesgo para la cadena de suministro», debido a que el CEO de Anthropic, Dario Amodei, se negó a permitir al gobierno federal usar sus modelos de IA sin restricciones; posteriormente, Anthropic demandó al Pentágono por esa determinación y buscó continuar colaborando con otros departamentos gubernamentales.

Preguntas frecuentes

¿Qué usos permite el acuerdo confidencial de IA entre Google y el Pentágono?

Según un reporte del New York Times citando a personas familiarizadas con el asunto, el acuerdo permite al DoD usar la IA de Google para «cualquier uso gubernamental legítimo». Un portavoz de Google dijo que la empresa insiste en que la IA no debe usarse para vigilancia masiva en el país ni para armas autónomas sin supervisión humana.

¿Con qué empresas de IA ha firmado el Pentágono acuerdos similares?

De acuerdo con un reporte del New York Times, el Pentágono el mes pasado ya firmó acuerdos que permiten desplegar IA en redes confidenciales, respectivamente, con OpenAI y xAI; el acuerdo de Google es el caso más reciente de cooperación del mismo tipo.

¿Cuál es la postura de Anthropic sobre temas similares?

Según reportes relacionados, en marzo de este año el Pentágono catalogó a Anthropic como una empresa de «riesgo para la cadena de suministro», por el motivo de que Anthropic rechazó permitir al gobierno federal usar sin límites sus modelos de IA; posteriormente, Anthropic demandó al Pentágono por esa determinación y buscó continuar colaborando con otros departamentos gubernamentales.

Related News

Medio estadounidense: el borrador de una orden ejecutiva de la Casa Blanca permite que el modelo Anthropic Mythos entre en el gobierno

Citigroup ajusta la valoración del mercado de IA a 4,2 billones de dólares y pronostica CapEx en 8,9 billones

DeepMind × Corea MOU: Primer campus universitario de IA en el extranjero, Hassabis firma en persona

Google y el Pentágono firman un contrato de IA confidencial; cientos de empleados se manifiestan en contra, sin resultados

Microsoft y OpenAI renuevan el acuerdo: cancelan la exclusividad y eliminan la cláusula de AGI